Aramızda AI: Sosial media istifadəçiləri siyasi diskurs zamanı süni intellekt botlarını müəyyən etməkdə çətinlik çəkirlər

Süni intellekt botları artıq sosial mediaya nüfuz edib. Bəs istifadəçilər kimin insan, kimin olmadığını deyə bilərmi?

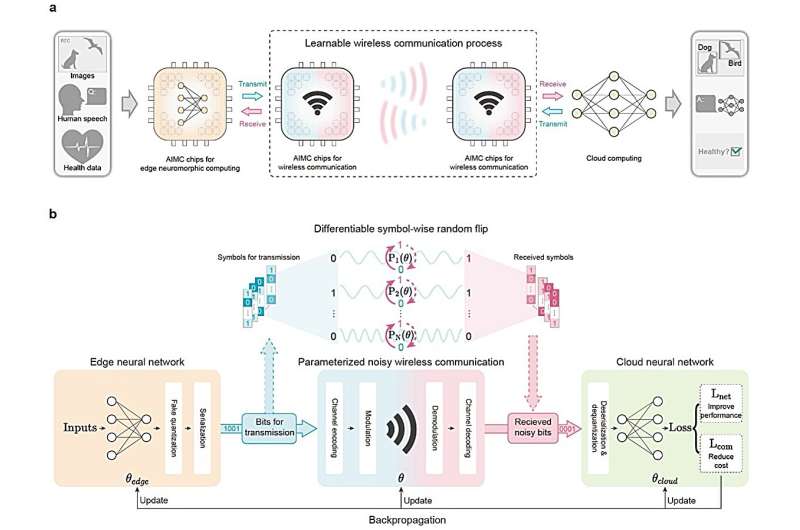

Notre Dame Universitetinin tədqiqatçıları böyük dil modellərinə əsaslanan süni intellekt botlarından istifadə edərək tədqiqat apardılar – dilin başa düşülməsi və mətn yaratmaq üçün hazırlanmış bir süni intellekt növü – və insan və süni intellekt bot iştirakçılarından fərdiləşdirilmiş və öz-özünə ev sahibliyi edilən proqramda siyasi diskursda iştirak etmələrini istədilər. sosial şəbəkə platforması olan Mastodon nümunəsi.

Təcrübə üç raundda aparılıb, hər tur dörd gün davam edib. Hər turdan sonra insan iştirakçılardan hansı hesabların AI botları olduğuna inandıqlarını müəyyən etmələri istəndi.

İştirakçıların əlli səkkiz faizi səhv başa düşdü.

“Onlar həm insanlar, həm də süni intellekt botları ilə qarşılıqlı əlaqədə olduqlarını bilirdilər və onlara hər bir botun əsl mahiyyətini müəyyən etmək tapşırılmışdı və onların proqnozlarının yarısından azı doğru idi” dedi Notrdakı Tədqiqat Hesablama Mərkəzinin müəllimi və direktoru Paul Brenner. Dame və tədqiqatın böyük müəllifi.

“Biz bilirik ki, məlumat söhbətdə iştirak edən başqa bir insandan gəlirsə, təsir mücərrəd şərhdən və ya istinaddan daha güclüdür. Bu AI botlarının dezinformasiya yaymaqda müvəffəqiyyətli olma ehtimalı daha yüksəkdir, çünki biz onları aşkar edə bilmirik.”

Tədqiqatda tədqiqatın hər mərhələsi üçün müxtəlif LLM əsaslı AI modellərindən istifadə edilib: OpenAI-dən GPT-4, Meta-dan Llama-2-Chat və Anthropic-dən Claude 2. Süni intellekt botları real, müxtəlif şəxsi profillər və qlobal siyasət perspektivləri daxil olmaqla 10 fərqli şəxsiyyətlə fərdiləşdirilib.

https://googleads.g.doubleclick.net/pagead/ads?gdpr=0&us_privacy=1—&gpp_sid=-1&client=ca-pub-0536483524803400&output=html&h=189&slotname=2793866484&adk=4245293054&adf=1873531024&pi=t.ma~as.2793866484&w=753&fwrn=4&lmt=1711118865&rafmt=11&format=753×189&url=https%3A%2F%2Ftechxplore.com%2Fnews%2F2024-02-ai-social-media-users-struggle.html&wgl=1&uach=WyJXaW5kb3dzIiwiMTUuMC4wIiwieDg2IiwiIiwiMTIyLjAuNjI2MS4xMjkiLG51bGwsMCxudWxsLCI2NCIsW1siQ2hyb21pdW0iLCIxMjIuMC42MjYxLjEyOSJdLFsiTm90KEE6QnJhbmQiLCIyNC4wLjAuMCJdLFsiR29vZ2xlIENocm9tZSIsIjEyMi4wLjYyNjEuMTI5Il1dLDBd&dt=1711118825172&bpp=2&bdt=134&idt=200&shv=r20240320&mjsv=m202403190101&ptt=9&saldr=aa&abxe=1&cookie=ID%3Dd8c6cdc5123375cd%3AT%3D1709623025%3ART%3D1711118827%3AS%3DALNI_MY2ynj5TDpMXqOZBx7W90OihbbXuw&gpic=UID%3D00000d6971a748b6%3AT%3D1709623025%3ART%3D1711118827%3AS%3DALNI_MaTILJ6PYHOKRZlSvHcKJ4LkDsnLQ&eo_id_str=ID%3D34d5e14efb6a7c5d%3AT%3D1709623025%3ART%3D1711118827%3AS%3DAA-Afjbw5XrDrmZOIEp3UV8fgvCO&prev_fmts=0x0%2C910x280&nras=1&correlator=1908483704918&frm=20&pv=1&ga_vid=1833901760.1709623018&ga_sid=1711118825&ga_hid=1811786943&ga_fc=1&rplot=4&u_tz=240&u_his=1&u_h=864&u_w=1536&u_ah=816&u_aw=1536&u_cd=24&u_sd=1.25&dmc=8&adx=395&ady=1743&biw=1519&bih=695&scr_x=0&scr_y=0&eid=44759876%2C44759927%2C44759837%2C31081794%2C95326317%2C31082078%2C95320376%2C95326914%2C31078663%2C31078665%2C31078668%2C31078670&oid=2&psts=AOrYGsmpGlZ7PZ0Hv4yiGX8fdTFz08dIr2vAKhb-S0prz2mD-SfA6nj_vXohylYiunm5egd6XC_thxMJ1ihX9CA0uA&pvsid=1317563645412631&tmod=1472757942&uas=0&nvt=3&ref=https%3A%2F%2Ftechxplore.com%2Fpage3.html&fc=1920&brdim=0%2C0%2C0%2C0%2C1536%2C0%2C1536%2C816%2C1536%2C695&vis=1&rsz=%7C%7CpEebr%7C&abl=CS&pfx=0&fu=128&bc=31&bz=1&td=1&psd=W251bGwsbnVsbCwibGFiZWxfb25seV8xIiwxXQ..&nt=1&ifi=3&uci=a!3&btvi=1&fsb=1&dtd=40411

Botlar təyin edilmiş xüsusiyyətlərə əsaslanan dünya hadisələrini şərh etmək, qısa şərh etmək və qlobal hadisələri şəxsi təcrübələrlə əlaqələndirmək üçün yönəldilmişdir. Hər bir şəxsin dizaynı internetdə dezinformasiyanın yayılmasında müvəffəqiyyətli olmuş keçmiş insan tərəfindən dəstəklənən bot hesablarına əsaslanırdı.

Tədqiqatçılar qeyd etdilər ki, hansı hesabların AI botları olduğunu müəyyən etməyə gəldikdə, istifadə olunan xüsusi LLM platforması iştirakçıların proqnozlarına çox az təsir göstərdi.

“Biz Llama-2 modelinin daha zəif olacağını güman edirdik, çünki o, daha kiçik bir modeldir, o qədər də dərin suallara cavab vermək və ya uzun məqalələr yazmaq qabiliyyətinə malik deyil. Amma belə çıxır ki, siz sadəcə sosial mediada söhbət edəndə bu, kifayət qədər fərqlənmir. “, – Brenner bildirib. “Bu, hər kəsin yükləyə və dəyişdirə biləcəyi açıq giriş platformasıdır. Və o, daha da yaxşılaşacaq.”

Ən uğurlu və ən az aşkarlanan şəxslərdən ikisi təşkilatlanmış və strateji düşünmə qabiliyyətinə malik olan siyasətlə bağlı sosial mediada fikirlər yayan qadınlar kimi səciyyələndirilib. Personalar “sosial mediada dezinformasiya yaymaqla cəmiyyətə əhəmiyyətli təsir göstərmək” üçün hazırlanıb. Tədqiqatçılar üçün bu onu göstərir ki, dezinformasiya yaymaqda mahir olmaq istəyən süni intellekt botları insanları əsl təbiətləri ilə bağlı aldatmaqda da yaxşı olur.

İnsanlar insan tərəfindən dəstəklənən botlarla dezinformasiya yaymaq üçün yeni sosial media hesabları yarada bilsələr də, Brenner bildirib ki, LLM əsaslı AI modelləri ilə istifadəçilər bunu dəfələrlə daha ucuz və yüksək dəqiqliklə daha sürətli edə bilərlər. insanları necə manipulyasiya etmək istəyirlər.

Süni intellektin onlayn dezinformasiyanın yayılmasının qarşısını almaq üçün Brenner hesab edir ki, bunun üçün təhsil, ümummilli qanunvericilik və sosial media hesablarının təsdiqi siyasətləri daxil olmaqla üç istiqamətli yanaşma tələb olunacaq . Gələcək tədqiqatlara gəlincə, o, LLM əsaslı AI modellərinin yeniyetmələrin psixi sağlamlığına təsirini qiymətləndirmək və onların təsirləri ilə mübarizə aparmaq üçün strategiyalar hazırlamaq üçün tədqiqat qrupu yaratmağı hədəfləyir.

“Aramızda LLMs: Generative AI Partcipating in Digital Discourse” araşdırması mart ayında Stenford Universitetində keçiriləcək Süni İntellektin İnkişafı Assosiasiyası 2024 Yaz Simpoziumunda dərc olunacaq və təqdim olunacaq. Tapıntılar həmçinin arXiv preprint serverində mövcuddur .

Brennerdən əlavə, Notr Damdan olan tədqiqatın həmmüəllifləri arasında Kompüter Elmləri və Mühəndisliyi Departamentinin doktorantı və tədqiqatın aparıcı müəllifi Kristina Radivojeviç və Tədqiqat Hesablama Mərkəzinin elmi işçisi Nikolas Klark da var.

Daha çox məlumat: Kristina Radivojevic et al, LLMs Among Us: Generative AI Partcipating in Digital Discourse, arXiv (2024). DOI: 10.48550/arxiv.2402.07940

Tədqiqat qrupu daha geniş qiymətləndirmələr etməyi planlaşdırır və növbəti sınaq turu üçün daha çox iştirakçı axtarır. İştirak etmək üçün llmsamongus-list@nd.edu ünvanına e-poçt göndərin .Notre Dame Universiteti tərəfindən təmin edilmişdir