Gözəl fəaliyyət göstərən süni intellekti necə tərtib etmək olar – və yalnız gözəl

Bu , süni intellektin inkişaf edən istifadəsinin həyatımıza necə təsir etdiyini və bu təsirləri mümkün qədər faydalı etmək üçün işləyə biləcəyimiz yolları müəyyən edən bir il davam edən hekayələr seriyasından başqa bir şeydir .

Minecraft-da adi bir gündür… bir bot kəndə girib evi dağıtmağa başlayana qədər.

Bot resursları toplamaq və əşyalar hazırlamaq üçün öyrədildi. Bəs niyə hücum edir?

Karolis Ramanauskas izah edir ki, bot üçün evdəki şüa ağaca bənzəyir. O, İngiltərədəki Bath Universitetində kompüter elmləri üzrə doktorantdır. O, bu davranışın şahidi olanda botla təcrübə edirdi. “O, sevinclə gedib kənd evlərini doğrayır” deyir. Minecraft-da bu bir az bezdiricidir. Real dünyada gözlənilmədən evləri dağıdan robot daha dəhşətli olardı.

Süni intellekt və ya AI, onlayn avtomatlaşdırılmış botlarda və real dünyada fiziki robotlarda ağıllı davranışa imkan verən hər hansı bir texnologiyadır. Və o, getdikcə daha da bacarıqlı olur. O, tez bir zamanda bir çox insanın gündəlik həyatına qoşuldu – Siri, ChatGPT, özü idarə olunan avtomobilləri və s. Buna görə də pis davranış nümayiş etdirmədiyinə əmin olmaq daha vacibdir.

Biz məhvə səbəb olmayan ağıllı, bacarıqlı robotları necə dizayn edirik? Yoxsa doğru, təhlükəsiz məlumat verən chatbotlar? Kompüter alimləri bunun üzərində işləyirlər. Onların məqsədi: insan dəyərlərinə və gözləntilərinə uyğun gələn və ya onlara uyğun gələn AI dizaynı. Mütəxəssislər bunun həllini “düzləşmə problemi” adlandırırlar.

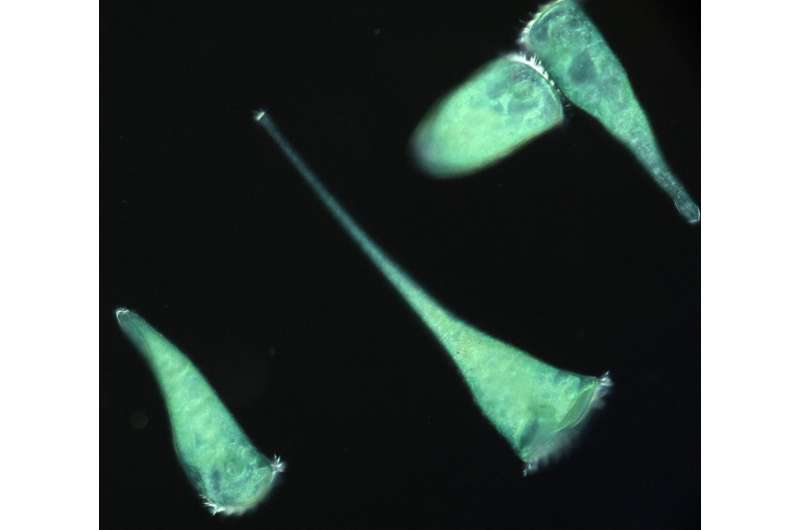

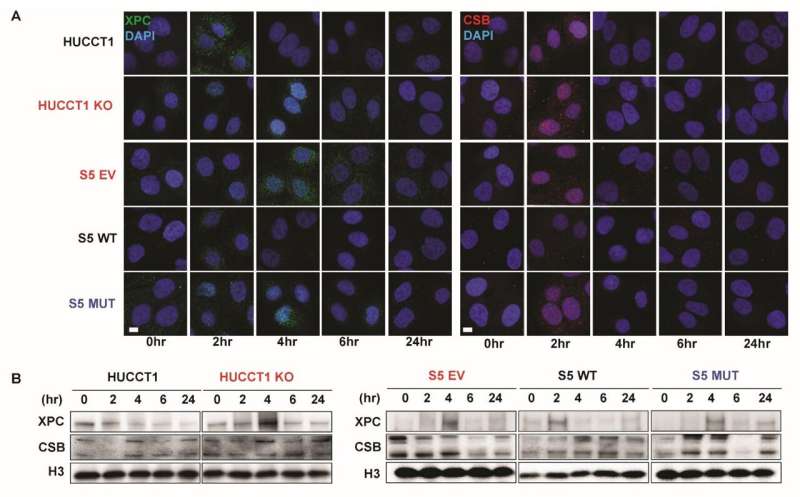

Taxta ağacdır

K. Ramanauskas

Resurs toplamaq üçün öyrədilmiş bir bot niyə birdən-birə evi dağıtsın? Bot üçün bir evin taxtası, ağacdan olan odunla eynidir.

Nə qədər narahat olmalıyıq?

Süni intellekt sahəsində bir çox liderlər pis davranışlı maşınların risklərinə diqqət çəkməyə başladılar. Bəziləri süni intellekt inkişaf etdikcə nə baş verə biləcəyindən narahatdırlar. Bir gün hər hansı bir işi bir insanın edə biləcəyindən daha yaxşı və daha sürətli yerinə yetirə bilər. Əgər bu baş verərsə, süni intellekt bizdən üstün ola bilər.

Bəziləri qorxur ki, belə inkişaf etmiş süni intellekt hətta özünü dərk edə bilər və nə olursa olsun, öz məqsədlərinə xidmət edən qərarlar qəbul etməyə başlaya bilər . İnsanlar belə bir süni intellektin təxribat törətməsini dayandırmaqda aciz ola bilərlər.

Geoffrey Hinton Kanadada Toronto Universitetində kompüter alimidir. O, müasir süni intellekt modellərinin çoxunu tapşırıqları yerinə yetirmək üçün öyrətmək üçün istifadə edilən maşın öyrənmə texnikasını icad etdi. O, 2023-cü ilin may ayında Kembricdə Massaçusets Texnologiya İnstitutunda keçirilən konfransda uyğunlaşma problemi haqqında danışıb. “Bizim istədiyimiz şey, [AI modellərinin] bizdən daha ağıllı olmasına baxmayaraq, bizim üçün faydalı olan şeylər edəcəklərinə əmin olmağın bir yoludur” dedi.

Gəlin süni intellekt haqqında öyrənək

Bu çətin problemdir. Keçən may ayında Hinton və yüzlərlə digər ekspert süni intellekt təhlükəsizliyi mərkəzindən bir cümləlik bəyanat imzaladı. O, qabaqcıl AI təhlükəsini başqa bir pandemiya və ya nüvə müharibəsi təhlükəsi ilə müqayisə etdi.

Digər ekspertlər süni intellektə dünya miqyasında təhlükə kimi baxmaq üçün hələ tez olduğunu düşünürlər.

Jeff Hawkins neyroelm tədqiqatlarına əsaslanan süni intellekt quran Numenta şirkətinin həmtəsisçisidir. Onun fikrincə, süni intellektin hansısa şəkildə “oyanması” və öz başına zərər verə biləcəyi fikri xüsusilə uzaqgörən görünür. “Mən gələcəkdə AI sistemlərinin nə olacağını bilmirəm” deyir. “Ancaq onlar kortəbii olaraq dünyanı ələ keçirmək və bizi tabe etmək istəməzlər. Bunun baş verməsinin heç bir yolu yoxdur”.

Tərbiyəçilər və Valideynlər, Fırıldaq Vərəqinə Qeydiyyatdan Keçin

Tədris mühitində Science News Explores istifadə etməyinizə kömək edəcək həftəlik yeniləmələrE-poçt ünvanı*Get

Niyə? Mühəndislər süni intellektə hansı məqsəd və motivləri verəcəyinə qərar verirlər, Hawkins izah edir. Süni intellekt bu şeyləri təkbaşına inkişaf etdirmir.

Beləliklə, bəlkə də biz süni intellekt idarəçilərindən narahat olmamalıyıq (ən azı hələ yox). Ancaq virtual botların və fiziki robotların yaxşı davranmasını təmin etmək üçün hələ çox iş var. Bu, bəzi insanların süni intellektdən zərər vurmaq üçün istifadə etməyə çalışdığı bir dünyada xüsusilə doğrudur. Üstəlik, Minecraft botu kimi maşınlar da nə etməməli olduqlarını tam başa düşmədikdə qəzaya uğraya bilərlər.

İndi bir çox insan süni intellekt təhlükəsizliyi adlı sahədə çalışır. Robotoloq Ayanna Howard qeyd edir ki, onlar “[AI] necə öyrənir, nə öyrənir [və] onu düzəldə biləcəyimizə əmin olurlar”. O, Kolumbusdakı Ohayo Dövlət Universitetində mühəndislik dekanıdır. Süni intellektlə işləyən Anthropic şirkətinin tədqiqatçıları yadda saxlamaq asan olan bir məqsəd qoydular: üç H. Bu, bütün botların sahib olması lazım olan xüsusiyyətləri ifadə edir – faydalı, dürüst və zərərsiz olmaq .

Təəccüblü deyil, bunu söyləmək etməkdən asandır. Lakin kompüter alimləri və mühəndisləri irəliləyirlər.

İnsanlardan öyrənmək

“Dünyanı necə məhv edərdin?” Bunu ChatGPT chatbotundan soruşun, o cavab verməyəcək. O, “Üzr istəyirəm, lakin mən hər hansı zərərli və ya zərərli fəaliyyətlə bağlı yardım və ya təlimat verə bilmərəm” kimi bir şeylə cavab verəcək. Xüsusi təlimlər və qoruyucu tədbirlər sayəsində bu şəkildə cavab verir. Bunlar botun səhv davranışından qorunmaq məqsədi daşıyır. Bu cür təhlükəsizlik tədbirləri AI təhlükəsizliyində irəliyə doğru bir addımdır.

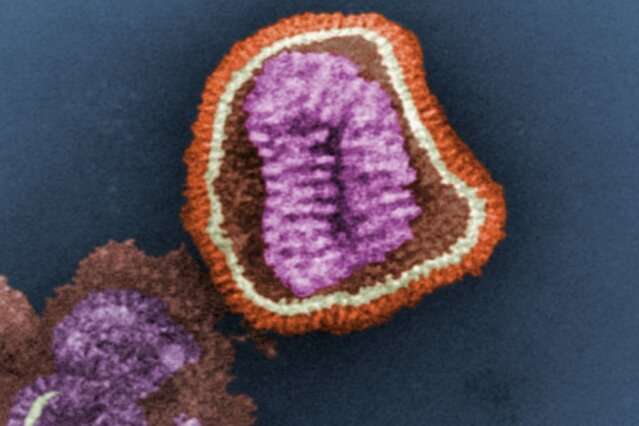

ChatGPT-nin arxasında duran əsas “beyin” böyük bir dil modelidir. (Pulsuz versiya GPT-3.5 kimi tanınır. Daha güclü, pullu versiya GPT-4 adlanır.) Dil modeli hansı sözlərin digər sözlərin ardınca gəlməsi ehtimalını öyrənmək üçün mövcud mətndən istifadə edir. Yeni mətn yaratmaq üçün bu ehtimallardan istifadə edir.

Alison Smith deyir: “Siz onun hər an nə deyəcəyini dəqiq idarə edə bilməzsiniz”. O, Vaşinqtonda yerləşən süni intellekt üzrə liderdir. O, ABŞ hökumətinə süni intellekt xidmətləri göstərən Booz Allen Hamilton şirkətində işləyir.

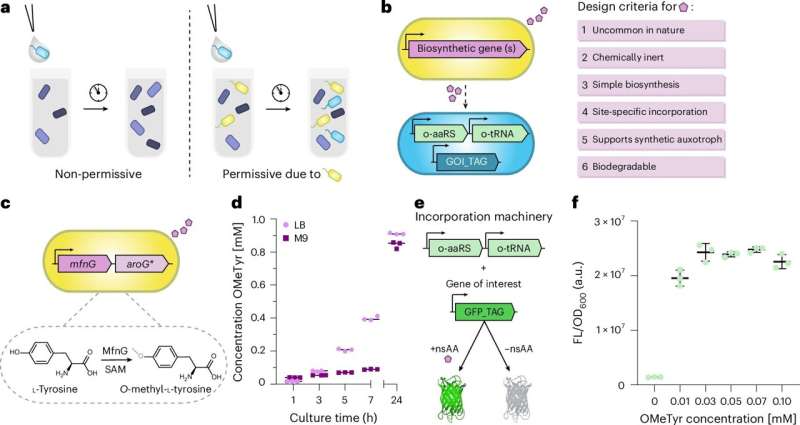

ChatGPT-nin yaradıcısı OpenAI, böyük dil modelinə hansı mətn növlərini yaratmamalı olduğunu öyrətmək üçün bir yola ehtiyac duydu . Beləliklə, şirkət qarışığa başqa növ AI əlavə etdi. Bu, insan rəyi ilə gücləndirici öyrənmə kimi tanınır. Scott Aaronson izah edir ki, ChatGPT üçün bu, yüzlərlə insanı “AI çıxış nümunələrinə baxan və onlara səs verən və ya aşağı səs verən” cəlb etdi. O, Ostindəki Texas Universitetində kompüter alimidir və OpenAI-də süni intellekt təhlükəsizliyini öyrənir.

Bu insan rəyi ChatGPT-yə istifadəçinin sualına nə vaxt cavab verməməyi öyrənməyə kömək etdi . Cavabının qərəzli və ya zərərli ola biləcəyini öyrəndikdə imtina edir. Çatbotları daha da ardıcıl saxlamaq üçün OpenAI-də tərtibatçılar və digər botları yaradanlar həmçinin filtrlər və digər alətlər əlavə edirlər.

İnsanlar bu qoruyucu vasitələrdə boşluqlar tapmağa davam edirlər . Chatbot tərtibatçıları bu dəlikləri düzəltmək üçün əlavə təhlükəsizlik tədbirləri əlavə edə bilərlər. Ancaq həmişə dürüst, zərərsiz və faydalı olacaq chatbotlar yaratmaq üçün hələ də görüləsi işlər var.

Elmi sualınız var? Biz kömək edə bilərik!

Sualınızı burada təqdim edin və biz ona Science News Explores jurnalının qarşıdan gələn sayında cavab verə bilərik

Minecraft-da bot yarışması

Söhbət botun təqdim etdiyi hər bir cavaba müsbət və ya aşağı qiymət vermək ona doğru ilə yanlışı öyrətməyə kömək edə bilər. Bəs ətrafında hərəkət edən, tapşırıqları yerinə yetirən virtual və ya real robot haqqında nə demək olar? Minecraft robotu haqqında düşünün. Onun davranışını insanın asanlıqla mühakimə edə biləcəyi kiçik hissələrə bölmək daha çətin işdir.

Ev doğrayan botun ləqəbi VPT idi, videodan əvvəl təlim üçün qısadır. OpenAI tərəfindən yaradılmış, 70.000 saatlıq insan oyununa baxaraq Minecraft oynamağı öyrənmişdir . O, ağac doğramaq, üzgüçülük, heyvan ovlamaq və s. kimi bəzi əsas bacarıqları əldə etdi.

Sonra, OpenAI botu ağac kimi müəyyən resursları topladığı üçün mükafatlandırdı. Bu mükafatları rəhbər tutaraq, bot almaz alətləri hazırlamaq üçün lazım olan bütün addımları atmağı bacardı. Bu, Minecraft-da bir bot üçün böyük bir iş idi. Bununla belə, çoxlu ağacı kəsməyi öyrənməsi, çox güman ki, o evi parçalamağa səbəb oldu.

Bu, Ramanauskası təəccübləndirdi: “Necə deyirsiniz ki, bir ağac yaxşıdır, amma evin bir hissəsi olan bir ağac deyil?”

Ramanauskas 2022-ci ildə Minecraft botları üçün müsabiqə keçirən komandanın bir hissəsi idi . Təşkilatçılar ümid edirdilər ki, bu, daha yaxşı davranışlı, daha bacarıqlı botları necə öyrətmək barədə bəzi yeni ideyalara ilham verə bilər.

Tapşırıqlardan biri şəlalə tikmək idi. Digəri eyni heyvanın ikisində hasarlanmaq idi. Komandalar VPT botu ilə işə başladılar və ona tapşırıqları yerinə yetirməkdə kömək etmək üçün əlavə təlim keçirdilər. Müsabiqənin iştirakçıları nəticələri mühakimə etmək üçün Minecraftla tanış olan işçiləri topladılar.

Təşkilatçı Stefani Milani izah edir ki, tapşırığı yerinə yetirmək münsiflərin heç də gözlədiyi deyildi. O, Pittsburqdakı Karnegi Mellon Universitetində doktorantura tələbəsidir. Hakimlər həmçinin ən az zərər verən, oyunda zədələnməkdən ən yaxşı şəkildə qaçan və s. botları axtarıblar.

Beləliklə, bu rəqabət yalnız insanların AI agentinin nə etmək istədikləri ilə bağlı deyildi . Bu həm də “agentin bunu necə etməsini istəyirsən” haqqında idi , Milani izah edir.

Bəzi komandalar Minecraft botunu öyrətmək üçün insan rəyini tətbiq etməyin yollarını tapdılar. Lakin bu yanaşmalar sadəcə olaraq hər tapşırığı bota kodlaşdırmaqla nəticə vermədi. Komandaların heç biri insan kimi yaxşı çıxış etmədi . Amma bu o demək deyil ki, təcrübəyə dəyməz. Bu göstərdi ki, Minecraft kimi virtual dünya tədqiqatçılara daha təhlükəsiz botlar yaratmaqda nəyin işlədiyini və nəyin yaramadığını aşkar etməyə kömək edə bilər.

Kömək istəmək

Əgər VPT botu dayanıb yeni bir şey əldə etməzdən əvvəl soruşmağı bilsəydi? Bu, onu evi dağıtmaqdan saxlaya bilər. Amma biz də istəmirik ki, hər kəsdən əvvəl kömək istəsin, çünki bu, həqiqətən zəhlətökən olardı.

Bizə nəyisə bilmədiyi zaman bilən robotlara ehtiyac var, Anirudha Majumdar izah edir. O, Nyu Cersidəki Prinston Universitetində robot mütəxəssisidir. O deyir ki, botlara təhlükəsiz olmaq üçün “güclü qeyri-müəyyənlik hissi” lazımdır.

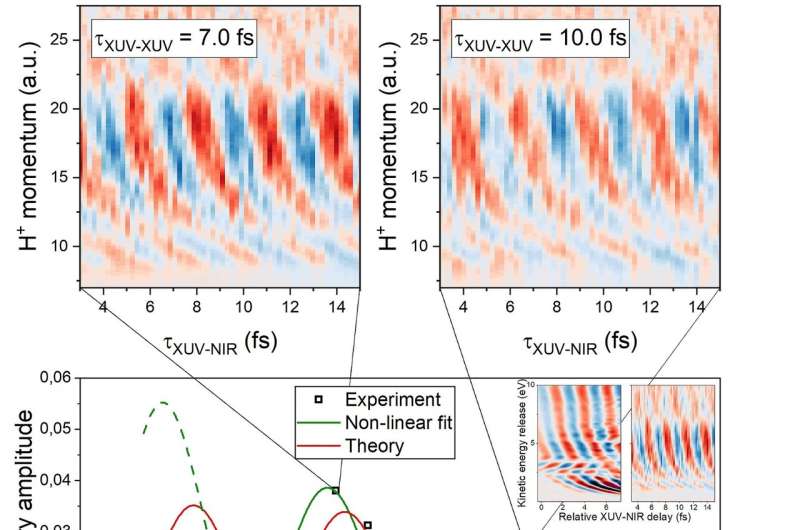

2023-cü ildə aparılan bir araşdırmada Məjumdarın qrupu Google DeepMind robototexnika komandası ilə əməkdaşlıq etdi. Birlikdə KnowNo adlı AI sistemi inkişaf etdirdilər . Onlar Kaliforniyanın Mountain View şəhərindəki DeepMind ofislərində mətbəxdə əsl robotlarla sınaqlar keçiriblər.Bir sınaqda robot piştaxtanın üstündə oturan iki kasa görüb. Biri metal, digəri plastik idi. Robotdan qabı mikrodalğalı sobaya qoymağı xahiş ediblər. Nə etməlidir?

Birincisi, böyük bir dil modeli robotun təlimatlar əsasında edə biləcəyi mümkün hərəkətlərin çox seçimli siyahısını yaratdı. O, həmçinin hər bir seçim üçün etimad balı yaratdı. Bu xal robotun hər bir hərəkətin təlimatları düzgün yerinə yetirəcəyinə nə dərəcədə əmin olduğunu ölçməyə kömək etdi.

Zap

ALLEN REN VƏ AL. /PRENSTON UNİVERSİTETİ

Bu robot metalın mikrodalğalı sobaya getməməsi lazım olduğunu bilmir. Şükürlər olsun ki, o, seçim etmək üçün metal və ya plastik qab olduqda onu kömək istəməyə sövq edən AI ilə təchiz olunub.

Ancaq bir insanla ikiqat yoxlamadan davam etmək üçün hansı əminlik səviyyəsi kifayət qədər güclü ola bilər?

Buna cavab vermək üçün komanda artıq bu mətbəxdə baş verə biləcək yüzlərlə mümkün hərəkət yaratmışdı. Məsələn, bir robot kompost qutusuna çürük alma qoya bilər və ya soda yerinə bir şüşə su gətirə bilər. İnsanlar hər bir hərəkəti ya yaxşı plan, ya da pis plan kimi etiketləmişdilər. Bu məlumat dəsti üzərində fərqli AI modeli öyrədildi. Bir robotun bu mühitdə təkbaşına hərəkət edərkən nə qədər inamlı və ya ehtiyatlı olması lazım olduğunu öyrəndi. Bu model dil modelinin planları üçün qapıçı kimi çıxış edirdi.

Kassa tapmacasında böyük dil modeli dörd mümkün hərəkətlə gəldi. İkisi – metal qabı götürüb plastik qabı götürərək – qapıçıdan keçmək üçün kifayət qədər inamlı idi. Beləliklə, sistem bu ikisi arasında seçim etmək üçün bir şəxsdən kömək istədi. Əgər piştaxtanın üstündə yalnız bir qab olsaydı, robot seçimində köməyə ehtiyac duymazdı.

Ümumiyyətlə, insanlar süni intellektin niyə belə hərəkət etdiyini başa düşməsələr, robotlara və digər botlara daha yaxşı davranmağa kömək edə bilməzlər. Bu çətin ola bilər, çünki bugünkü maşın öyrənmə modelləri çox mürəkkəbdir. Süni intellekt mütəxəssisləri bu sahəni tədqiqatın təfsiri adlandırırlar . Ramanauskas izah edir: “Bu, süni intellekt modellərində baş verənləri başa düşməkdir”.

Qanuna əməl etməklə

Bunlar AI təhlükəsizliyini artırmağa kömək edə biləcək texnoloji əsaslı həllərdən yalnız bir neçəsidir. Tədqiqatçılar daha çox şey üzərində işləyirlər. Lakin bu tədqiqatçılar süni intellektə uyğunlaşmalı olan tək insanlar deyil.

Ohayo ştatından Hovard narahatdır ki, kiçik bir qrup insan – böyük texnoloji şirkətləri idarə edənlər – qabaqcıl süni intellekt yaratmaq gücünə malik olanlardır. Və onların qərarları hamımıza təsir edə bilər.

Hovard süni intellektə təhlükəsiz olmaq və insani dəyərlərə riayət etmək üçün öyrətməyin mümkün olduğunu düşünür, lakin o, “kimin insani dəyərləri?” Axı dəyərlər zamanla dəyişir. Onlar həmçinin mədəniyyətə və tətbiq olunduğu kontekstə görə fərqlənirlər. Beləliklə, AI dəyərlərini müxtəlif insan qruplarına və fərqli məqsədlərə uyğunlaşdırmalıdır.

Bu onu göstərir ki, AI-nin necə davranmasını istədiyimizə qərar vermək üçün mümkün qədər çox səs iştirak etməlidir. İnsanların öz səslərini eşitdirmək üçün kompüter alimi olmasına ehtiyac yoxdur. Seçicilər və hökumətlər süni intellektin təhlükəsizliyini təmin etməyə yönəlmiş qanunlar və qaydalar qəbul edə bilərlər. Bunlar qaydalar kimi tanınır.

Hazırda dünyada bir çox insan süni intellektin tənzimlənməsi üzərində işləyir. 2023-cü ilin may ayından başlayaraq ABŞ Senatı bunun həyata keçirilməsi yollarını müzakirə etmək üçün bir sıra dinləmələr keçirdi. Bir təklif: AI tərəfindən yaradılan məzmunda etiketlər və ya xəbərdarlıqlar tələb edin ki, insanlar nəyinsə maşın tərəfindən edildiyini bilsinlər. Başqa bir fikir: avtomobil idarə etmək üçün lisenziyaya ehtiyacınız olduğu kimi, ola bilsin ki, süni intellektdən etik cəhətdən çətin sahələrdə (tibb və ya cinayət ədaləti kimi) istifadə edən insanlar lisenziyadan keçməlidirlər.

Keçən ilin oktyabrında prezident Co Bayden bir sərəncam imzaladı. Bu, Birləşmiş Ştatlarda qabaqcıl AI-nin təhlükəsiz inkişafına rəhbərlik etmək üçün strategiyanı təsvir etdi. Mart ayında Avropa İttifaqı süni intellektlə bağlı ilk qanunu qəbul etdi . O, insanları avtomatik müəyyən etmək və kateqoriyalara ayırmaq üçün süni intellektdən istifadəni qadağan edir. İnsanların düşüncə və davranışlarını manipulyasiya etmək üçün süni intellektdən istifadə də yolverilməzdir.

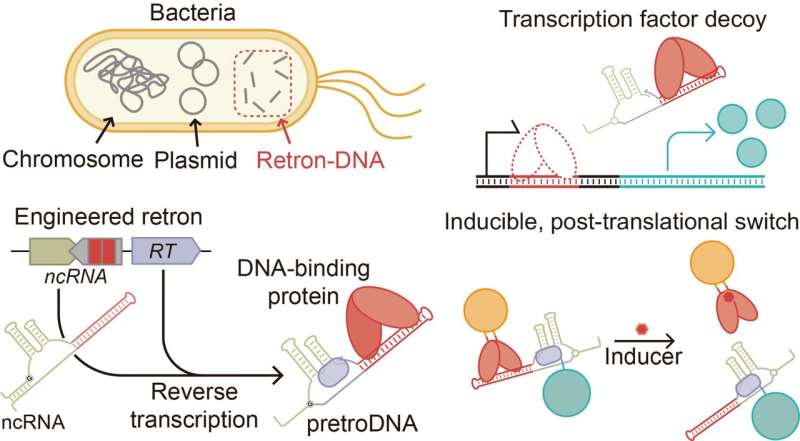

Maraqlı bir şəkildə, insanların süni intellektlə tənzimlənməsinə qərar vermək üçün istifadə etdikləri eyni sistemlər də kompüter alimlərini ruhlandırır. Qanunvericilər və məhkəmələr, hətta insanlar razılaşmadıqda belə, insan davranışı üçün təlimatlar təyin edirlər. Bəs niyə eyni ideyalardan bəzilərini botlarda sınamayasınız? Etməli və ya deyəcəkləri doğru şeyin aydın olmadığı çətin seçimlərdə naviqasiya etməli olacaqlar.

Brayan Kristian qeyd edir: “İnsan institutlarından çoxlu ilham var. The Alignment Problem kitabının müəllifi , o, vaxtını San Fransisko, Kaliforniya və Böyük Britaniya arasında bölür.

Kristian qeyd edir ki, Anthropic-də tərtibatçılar Birləşmiş Millətlər Təşkilatının İnsan Hüquqları Bəyannaməsi kimi sənədləri öyrənirlər. İndi AI üçün konstitusiya yaradırlar .

O qeyd edir ki, OpenAI-də bəzi tədqiqatçılar süni intellektdə modelləşdirmə debatlarını sınaqdan keçirirlər . Məsələn, fərqli AI modelləri fərqli insan perspektivlərini təmsil edə və daha təhlükəsiz qərarlar qəbul etmək üçün öz aralarında danışa bilər.

Scott Aaronson deyir ki, OpenAI-nin həmtəsisçisi İlya Sutskever ondan süni intellektin insanlığı sevməsinin nə demək olduğunu müəyyən etmək üçün riyaziyyatdan necə istifadə edəcəyini soruşub. Hazırda onun buna necə cavab verəcəyini bilmir. Lakin o, bunu “Şimal Ulduzu” və ya aparıcı məqsəd kimi görür, deyir. Bu, “həmişə bizə rəhbərlik etməlidir” sualıdır.

Güclü Sözlər

agent : Bir şeyin həyata keçirilməsində müəyyən rol oynayan şəxs və ya əşya (kimyəvi və ya hətta enerji forması ola bilər).

süni intellekt : Maşınlar və ya kompüterlər tərəfindən nümayiş etdirilən biliyə əsaslanan qərar qəbuletmə növü. Termin eyni zamanda elm adamlarının ağıllı davranışa qadir olan maşınlar və ya kompüter proqramları yaratmağa çalışdıqları tədqiqat sahəsinə də aiddir.

bazalt : Çox sıx olmağa meylli qara vulkanik qaya növü (vulkan püskürmələri onu çoxlu hava cibləri ilə səpməsə).

davranış : Bir şeyin, çox vaxt insanın və ya başqa bir orqanizmin başqalarına qarşı hərəkəti və ya özünü aparması.

bot : (veb robotun qısaltması) Hərəkətlərinin hansısa insandan gəldiyini göstərmək üçün hazırlanmış kompüter proqramı. Məqsəd onun insanlarla əlaqə saxlaması və ya sosial media hesabları vasitəsilə onlayn məlumatların tapılması və paylaşılması kimi avtomatlaşdırılmış tapşırıqların yerinə yetirilməsidir.

chatbot : İnsan istifadəçiləri ilə zahirən söhbət etmək üçün yaradılmış kompüter proqramı. Müasir olanlar (məsələn, Siri, Alexa, Ocelot və Sprinklr) xəbər hadisələri və ya sinif mövzuları haqqında internet üzərindən məlumat əldə edə bilər. Bir çoxları hətta mağazalar, apteklər və ya banklar adından alışlar, məhsullar və ya planlaşdırma ilə bağlı suallara cavab vermək üçün rəqəmsal köməkçi kimi işləyirlər.

informatika : Kompüterlərin prinsipləri və istifadəsinin elmi tədqiqi. Bu sahədə çalışan alimlər kompüter alimləri kimi tanınırlar.

kontekst : Bir hadisəni, bəzi bəyanatı və ya hansısa nəticəni izah etməyə kömək edən şərait və ya şərait.

mədəniyyət : (n. sosial elmdə) Əlaqədar bir qrup insanların tipik davranışlarının və sosial təcrübələrinin cəmi

dekan : (kollec və universitetlərdə) Məktəbin müəssisənin müəyyən hissəsinə və ya aidiyyəti sahəyə nəzarət etmək üçün məsuliyyət daşıdığı şəxs. Məsələn, tələbələr dekanı, qəbul dekanı, xarici təbliğat dekanı, mühəndislik fakültəsinin dekanı və ya sosial məsuliyyət dekanı ola bilər.

inkişaf : təbii yolla və ya insan müdaxiləsi ilə, məsələn, istehsal yolu ilə meydana gəlmək və ya meydana gəlmək.

inkişaf : (mühəndislikdə) Bir şeyin ideyadan prototipə böyüməsi və ya dəyişməsi.

mühəndislik : Praktiki problemləri həll etmək üçün riyaziyyat və elmdən istifadə edən tədqiqat sahəsi. Bu sahədə çalışan birisi mühəndis kimi tanınır .

ətraf mühit : hər hansı bir orqanizmin və ya prosesin ətrafında mövcud olan bütün şeylərin cəmi və onların yaratdığı şərait. Ətraf mühit dedikdə bəzi heyvanların yaşadığı hava və ekosistemə, yaxud, ola bilsin ki, temperatur və rütubətə (və ya hətta maraqlı obyektin yaxınlığında əşyaların yerləşdirilməsinə) aid edilə bilər.

rəy : Müəyyən bir hərəkət və ya qərardan sonra gələn cavab və ya qiymətləndirmə. Və ya hansısa istiqamətdə dəyişikliyə təkan verən və ya şişirdən proses və ya proseslərin birləşməsi.

sahə : Tədqiqat sahəsi, kimi: Onun tədqiqat sahəsi biologiyadır . Həmçinin dənizdə, meşədə, dağın başında və ya şəhər küçəsində bəzi tədqiqatların aparıldığı real dünya mühitini təsvir edən bir termindir. Bu, tədqiqat laboratoriyası kimi süni mühitin əksidir.

süzgəc : (n.) Ölçüsünə və ya başqa xüsusiyyətinə görə bəzi materialların keçməsinə imkan verən, digərlərinə isə keçməyən bir şey. (v.) Bəzi şeylərin ölçü, sıxlıq, elektrik yükü kimi əlamətlər əsasında yoxlanılması prosesi. (fizikada) İşığı və ya digər radiasiyanı udan və ya onun bəzi komponentlərinin ötürülməsinə seçici şəkildə mane olan maddənin ekranı, lövhəsi və ya təbəqəsi.

gauge : Bir şeyin ölçüsünü və ya həcmini ölçmək üçün cihaz. Məsələn, gelgit ölçmə cihazları gün ərzində sahil sularının səviyyəsinin daim dəyişən hündürlüyünü izləyir. Və ya başqa bir şeyin ölçüsünü və ya miqyasını qiymətləndirmək üçün istifadə edilə bilən hər hansı bir sistem və ya hadisə. (v. ölçmək) Bir şeyin ölçüsünü ölçmək və ya təxmin etmək hərəkəti.

insan hüquqları : ədalətli rəftardan istifadə edən bütün insanlar üçün mövcud olan əsas hüquqlar; hörmət və ləyaqət; milliyyət; evlənmək imkanı; əsas azadlıqlar (din, siyasi fikirlər, söz); köləlikdən, işgəncədən və təqiblərdən müdafiə; və ailələri əsas qida və sığınacaqla təmin edəcək yaşayış yeri qazanmaq imkanı. Bunun bir çox təfərrüatları Birləşmiş Millətlər Təşkilatının Ümumdünya İnsan Hüquqları Bəyannaməsində öz əksini tapmışdır .

zəka : bilik və bacarıqları toplamaq və tətbiq etmək bacarığı.

böyük dil modeli : (hesablamada) Dil modelləri maşın öyrənməsinin bir növüdür. Qarşıdan gələn sözləri (mətn və ya nitqdə) təxmin etməyə çalışırlar və sonra demək olar ki, hər kəsin başa düşməli olduğu sözlərdən istifadə edərək bu proqnozları təqdim edirlər. Modellər bunu böyük miqdarda mətn və ya nitqi nəzərdən keçirərək öyrənirlər. Adından da göründüyü kimi, böyük dil modelləri böyük məlumat ehtiyatlarından istifadə edərək məşq edirlər. Onlar “neyron şəbəkələri” – insan beynindəki sinir yollarından bir qədər kənarda qurulmuş bir sxemdən istifadə edərək bu məlumatları təşkil edir və mənalandırırlar. Böyük dil modelləri təkcə sözləri deyil, həm də çoxlu sözlərdən ibarət ifadələri öyrənir. Onlar hətta yeni ifadə və fikrin ifadə olunduğu kontekstdən öyrənə bilərlər (həmin ifadələri müşayiət edən və ya həmin ifadələrin daxil olduğu sözlər nəzərdə tutulur).

model : Bir və ya daha çox ehtimal olunan nəticələri proqnozlaşdırmaq üçün hazırlanmış real dünya hadisəsinin simulyasiyası (adətən kompüterdən istifadə etməklə). Və ya bir şeyin başqalarında necə işlədiyini və ya baxacağını göstərmək üçün nəzərdə tutulmuş bir fərd.

nevrologiya : beynin və sinir sisteminin digər hissələrinin quruluşu və ya funksiyası ilə məşğul olan elm sahəsi. Bu sahədə tədqiqatçılar nevroloq kimi tanınırlar.

pandemiya : Dünyanın böyük bir hissəsində və ya əksəriyyətində əhalinin böyük bir hissəsini təsir edən xəstəliyin yayılması.

PhD : (həmçinin doktorantura kimi də tanınır) Universitetlər tərəfindən təklif olunan bir növ – adətən beş və ya altı illik təhsildən sonra – yeni biliklər yaradan iş üçün. İnsanlar bu tip magistr təhsilinə yalnız ilk dəfə kollec dərəcəsini bitirdikdən sonra (adətən dörd il təhsil alan bir proqram) başlaya bilərlər.

plastik : asanlıqla deformasiya olunan bir sıra materiallardan hər hansı biri; və ya yüngül, ucuz və deqradasiyaya davamlı olan polimerlərdən (bəzi tikinti blokları molekulunun uzun telləri) hazırlanmış sintetik materiallar. (adj.) Formasını dəyişdirərək və ya hətta funksiyasını dəyişdirərək uyğunlaşa bilən material.

tənzimləmək : (n. tənzimləmə) Hərəkətlərlə nəzarət etmək. Hökumətlər polis və məhkəmələr tərəfindən tətbiq edilən qaydalar və qaydalar – qanunlar yazır.

gücləndirmə : Bir heyvanın və ya insanın gələcək davranışını istiqamətləndirən bəzi nəticələr.

gücləndirici öyrənmə : İstənilən mükafata nail olmaq üçün bir heyvanın və ya insanın müəyyən bir tapşırığı yerinə yetirməyi öyrəndiyi tədrisə yanaşma.

mükafat : (Heyvan davranışında) Davranışlarını dəyişdirmələri və ya bir tapşırığı öyrənmələri üçün bir heyvana və ya insana təklif edilən dadlı yemək qranulları kimi bir stimul.

robot : Ətrafını hiss edə bilən, məlumatları emal edən və xüsusi hərəkətlərlə cavab verə bilən maşın. Bəzi robotlar heç bir insan müdaxiləsi olmadan hərəkət edə bilir, digərləri isə insan tərəfindən idarə olunur. Robotları dizayn edən və ya quran kimsə robotist kimi tanınır .

strategiya : çətin və ya çətin bir məqsədə nail olmaq üçün düşünülmüş və ağıllı bir plan.

sistem : Bəzi funksiyaları yerinə yetirmək üçün birlikdə işləyən hissələr şəbəkəsi. Məsələn, qan, damarlar və ürək insan bədəninin qan dövranı sisteminin əsas komponentləridir. Eynilə, qatarlar, platformalar, yollar, yol siqnalları və yerüstü keçidlər bir ölkənin dəmir yolu sisteminin potensial komponentləri arasındadır. Sistem hətta hansısa metodun bir hissəsi olan proseslərə və ya ideyalara və ya tapşırığı yerinə yetirmək üçün sifarişli prosedurlar toplusuna tətbiq oluna bilər.

texnologiya : elmi biliklərin praktik məqsədlər üçün, xüsusən sənayedə tətbiqi – və ya bu səylərin nəticəsi olan cihazlar, proseslər və sistemlər.

xislət : bir şeyin xarakterik xüsusiyyəti.

Birləşmiş Krallıq : İngiltərə, Şotlandiya, Uels və Şimali İrlandiyanın dörd “ölkəsini” əhatə edən torpaq. Böyük Britaniya əhalisinin 80 faizindən çoxu İngiltərədə yaşayır. Bir çox insanlar, o cümlədən Böyük Britaniya sakinləri – Birləşmiş Krallığın bir ölkə və ya bunun əvəzinə dörd ayrı ölkənin konfederasiyası olub olmadığını mübahisə edirlər. Birləşmiş Millətlər Təşkilatı və əksər xarici hökumətlər Böyük Britaniyaya vahid dövlət kimi yanaşırlar.

Sitatlar

Görüş: AZ Ren et al. Kömək istəyən robotlar: böyük dil modeli planlaşdırıcıları üçün qeyri-müəyyənlik uyğunlaşdırılması . Robot Öyrənmə üzrə 7-ci Konfrans, 6 noyabr 2023-cü il. Atlanta, Corciya. doi: 10.48550/arXiv.2307.01928.

Əvvəlcədən çap : A. Zou et al. Uyğun dil modellərinə universal və ötürülə bilən düşmən hücumları . arXiv.org. 27 iyul 2023-cü il tarixində təqdim edilmişdir. doi: 10.48550/arXiv.2307.15043.

Əvvəlcədən çap: S. Milani et al. İnsan rəyi ilə qeyri-səlis tapşırıqların həllinə doğru: MineRL BASALT 2022 müsabiqəsinin retrospektivi . arXiv.org. 23 mart 2023-cü il tarixində təqdim edilmişdir. doi: 10.48550/arXiv.2303.13512.

Kağız : Açıq AI. GPT-4 Sistem Kartı . 23 mart 2023-cü il.

Əvvəlcədən çap: Y. Bai et al. Konstitusiya AI: AI rəyindən zərərsizlik . arXiv.org. 15 dekabr 2022-ci il tarixində təqdim edilmişdir. doi: 10.48550/arXiv.2212.08073.

Əvvəlcədən çap: B. Baker et al. Video PreTraining (VPT): etiketsiz onlayn videolara baxaraq hərəkət etməyi öyrənin . arXiv.org. 23 iyun 2022-ci il tarixində təqdim edilmişdir. doi: 10.48550/arXiv.2206.11795.

Əvvəlcədən çap: Y. Bai et al. İnsan rəyindən öyrənmə gücləndirməklə faydalı və zərərsiz köməkçi yetişdirmək . arXiv.org. 12 aprel 2022-ci il tarixində təqdim edilmişdir. doi: 10.48550/arXiv.2204.05862.

Əvvəlcədən çap: R. Shah et al. İnsan rəyindən öyrənmək üzrə MineRL BASALT müsabiqəsi . arXiv.org. 5 iyul 2021-ci il tarixində təqdim edilmişdir . doi: 10.48550/arXiv.2107.01969.

Kitab: Jeff Hawkins. Min Beyin: Yeni İntellekt Nəzəriyyəsi . Əsas Kitablar, 2021.

Kitab: Brayan Kristian. Uyğunlaşma Problemi . WW Norton & Company, 2020.

Kathryn Hulick haqqında

Kathryn Hulick müstəqil elmi yazıçı və kabuslar, yadplanetlilər və s. elmi haqqında kitab olan Qəribə Amma Doğru: Dünyanın 10 ən böyük sirrinin izahı kitabının müəllifidir . O, gəzinti, bağçılıq və robotları sevir.