Matris Jailbreak: Tədqiqatçılar süni intellekt baryerlərini necə aşaraq daha təhlükəsiz hala gətirirlər

Harrem Monkhorst, Florida Universiteti

Lisa Lock tərəfindən redaktə edilib , Robert Egan tərəfindən nəzərdən keçirilib

Tercih edilən mənbə kimi əlavə edin

Kredit: Pixabay/CC0 İctimai Sahə

Florida Kompüter və İnformasiya Elmləri və Mühəndisliyi Universitetinin (CISE) professoru, fəlsəfə doktoru Sumit Kumar Jha tərəfindən yazılmış bir məqalədə o qədər çox elmi fantastika termini var ki, bunun Hollivud ssenarisi olduğunu düşünsəniz, bağışlanacaq: Nullspace sükanı. Qırmızı komanda. Matris jailbreak. Lakin Jhanın işi qəti şəkildə real həyata yönəlib, ən əsası süni intellekt alətlərinə daxil edilmiş təhlükəsizlik tədbirlərinin gücləndirilməsi onların hamı üçün təhlükəsiz olmasını təmin edir.

Süni intellekt köməkçiləri yenilikdən infrastruktura keçdikcə, kod yazmağa kömək etdikcə, tibbi qeydləri ümumiləşdirdikcə və müştəri suallarını cavablandırdıqca, ən böyük sual təkcə bu sistemlərin nə edə biləcəyi deyil, həm də etməməli olduqları şeyi etməyə məcbur edildikdə nə baş verəcəyidir.

“Bu müdafiə sistemlərinin necə pozulduğunu dəqiq göstərməklə, süni intellekt inkişaf etdiricilərinə həqiqətən davamlı müdafiə sistemləri qurmaq üçün lazım olan məlumatları veririk”, – deyə Jha bildirib. “Güclü süni intellekt sistemlərinin ictimaiyyətə açıqlanması yalnız təhlükəsizlik tədbirləri real yoxlamaya davam gətirə bildikdə davamlı ola bilər və hazırda işimiz göstərir ki, hələ də boşluq var. Biz onu aradan qaldırmağa kömək etmək istəyirik.”

Tədqiqatla bağlı “Matrixin Jailbreaking: Controlled Model Subversion üçün Nullspace Steering” adlı məqalə 23-27 aprel tarixlərində Rio-de-Janeyroda keçirilən 2026-cı il Beynəlxalq Öyrənmə Təmsilçilikləri Konfransına ( ICLR 2026 ) qəbul edilib.

“Bu süni intellekt sistemləri xəstəxanalarda, banklarda və insanların hər gün asılı olduğu digər proqram təminatlarında yerləşdirilir. Kənardan verilən siqnallardan istifadə edərək belə bir şeyi sınaqdan keçirib “hər şey qaydasındadır” demək olmaz”, – deyə Jha bildirib. “Biz qapağı açırıq, daxili naqilləri çəkirik və hansının qırıldığını yoxlayırıq. Beləliklə, onu daha təhlükəsiz edirsiniz. Bunun üçün qısa yol yoxdur.”

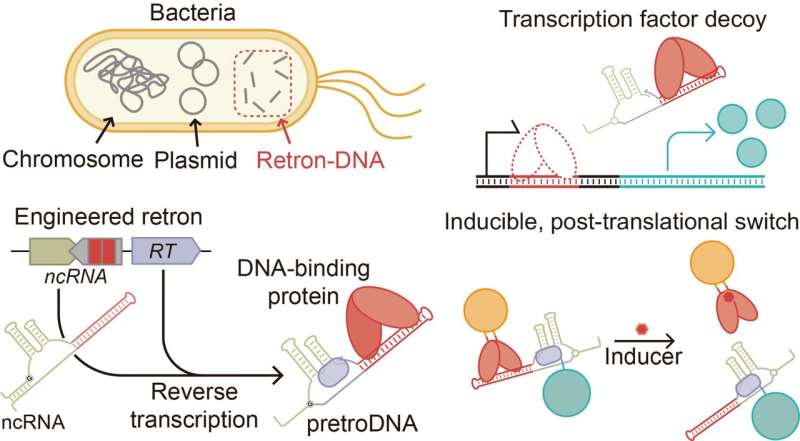

Süni intellekt modellərini daxildən araşdırmaq

Məqalədə təsvir edilən yeni metodlar alətləri içəridən araşdırır, yalnız istifadəçi istəklərinin ağıllı manipulyasiyalarına əsaslanmaq əvəzinə, onların “qərar yollarını” araşdırır. İş xüsusilə Meta və Microsoft tərəfindən təklif olunan stress test sistemlərinə yönəlib və onları daxili təhlükəsizlik səddlərinin limitlərini anlamaq üçün dizaynlarına zidd işləməyə məcbur edir. Sistemləri araşdırmaq üçün lazım olan böyük hesablamalar üçün komanda UF-nin HiPerGator superkompüterinin hesablama gücündən istifadə edəcək.

CISE doktorantı Vişal Pramanik və əməkdaşları Oklahoma Universitetindən Maişa Maliha və SRI International-dan doktorant Susmit Jha-dan ibarət komanda, istifadəçi sorğularına cavab olaraq hansı komponentlərin ən çox işlədiyini müəyyən etmək üçün LLM kimi tanınan böyük bir dil modelini araşdıran bir sistem hazırladı. Metod Baş Maskalı Nullspace Steering və ya HMNS adlanır.

Həmin aktiv komponentlər (“başlıqlar”) daha sonra qərar matrisinin öz hissələrini sıfırlamaqla susdurulur, digər komponentlər isə itələnir (“idarə olunur”) və modelin çıxışlarının necə dəyişdiyini görmək üçün ümumi sistem diqqətlə müşahidə olunur.

LLM-in daxili işinə diqqət yetirmək, təhlükəsizlik tədbirlərinin uğursuzluğuna qarşı daha güclü müdafiə vasitələrinin inkişafını təşviq edərkən, nasazlıqların daha dəqiq ölçülməsinə imkan verir. Tədqiqatçıların fikrincə, HMNS, müəyyən daxili yolların istismar edildiyi təqdirdə, qəzaya səbəb olub-olmadığını aşkar etməyə kömək edə bilər. Bu məlumat daha güclü təlim, monitorinq və müdafiə strategiyalarına istiqamət verə bilər.

Niyə daha güclü müdafiəyə ehtiyac var

LLM-lərin təhlükəsizlik çatışmazlıqlarını anlamaq, onların daha geniş yayılmasının vacibliyini göstərir. Meta, Alibaba və digər şirkətlər hər kəs üçün əlçatan olan güclü süni intellekt modelləri buraxıblar. Hər bir platformanın sui-istifadənin qarşısını almaq üçün nəzərdə tutulmuş təhlükəsizlik təbəqələri olsa da, UF komandası bu təhlükəsizlik təbəqələrinin sistematik şəkildə keçilə biləcəyini aşkar edib.

Jha üçün bu, ciddi bir narahatlıq doğurur.

HMNS etalonlara qarşı necə işləyir

Nəticələr ümidvericidir. HMNS, LLM-ləri qırmaqda olduqca yaxşı olduğunu sübut etdi. Həm hücumların uğurlu olma sürəti, həm də lazımi cəhdlərin sayı ilə ölçülən HMNS, dörd müəyyən edilmiş sənaye etalonu üzrə ən müasir metodlardan daha yaxşı nəticə göstərdi.

Müəlliflər tərəfindən ətraflı təsvir edilən sistemin başqa bir üstünlüyü var: səmərəlilik.

Müdafiə sistemləri arasında müqayisələri daha ədalətli etmək üçün müəlliflər sistemin sındırılmasında nə qədər hesablama gücündən istifadə edildiyini nəzərə alan hesablamaya əsaslanan hesabat sistemini təqdim etdilər. HMNS rəqiblərindən daha sürətli və daha az hesablama gücü ilə sistemləri sındırdı.

Müəlliflər vurğulayırlar ki, bu tədqiqat həm zəif cəhətləri, həm də müdafiəni gücləndirmək üçün imkanları aşkar edə bilər. Tədqiqatçılar məqalədə qeyd edirlər ki, “Məqsədimiz ümumi müdafiə altında nasazlıq rejimlərini təhlil etməklə LLM təhlükəsizliyini gücləndirməkdir; biz sui-istifadəyə imkan yaratmağa çalışmırıq.”

Daha çox məlumat

Matrixin Jailbreak edilməsi: İdarə Olunan Model Təxribatı üçün Nullspace Sükanı. openreview.net/forum?id=qlf6y1A4Zu

Əsas anlayışlar

Böyük dil modelləriMaşın öyrənmə metodologiyalarıFlorida Universiteti tərəfindən təmin edilir