Sıxılma texnikası süni intellekt modellərini hələ öyrənərkən daha incə və sürətli edir

Reyçel Qordon, Massaçusets Texnologiya İnstitutu

Lisa Lock tərəfindən redaktə edilib , Robert Egan tərəfindən nəzərdən keçirilib

Tercih edilən mənbə kimi əlavə edin

CompreSSM adlanan yeni bir texnika, təlim prosesinin əvvəlində lazımsız komponentləri cərrahi yolla çıxarmazdan əvvəl modelin hansı hissələrinin öz ağırlığını çəkdiyini müəyyən etməyə kömək edir. Müəllif: Alex Shipps/MIT CSAIL və Makram Chahine, Pixabay və Pexels-dən istifadə edərək.

Böyük bir süni intellekt modelini öyrətmək təkcə dollarla deyil, həm də vaxt, enerji və hesablama resursları baxımından baha başa gəlir. Ənənəvi olaraq, daha kiçik və daha sürətli bir model əldə etmək üçün ya əvvəlcə böyük bir modelin öyrədilməsi, sonra isə azaldılması, ya da kiçik bir modelin sıfırdan öyrədilməsi və daha zəif performansın qəbul edilməsi tələb olunur.

MIT-in Kompüter Elmləri və Süni İntellekt Laboratoriyası (CSAIL), Maks Plank İntellekt Sistemləri İnstitutu, Avropa Öyrənmə və İntellekt Sistemləri Laboratoriyası, ETH və Maye Süni İntellekt tədqiqatçıları bu kompromisdən tamamilə yayınan yeni bir metod hazırlayıblar. Modellər təlimdən sonra deyil, təlim zamanı sıxışdırılır.

SSM-ləri sıxışdırmaq üçün yeni bir yanaşma

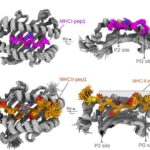

CompreSSM adlanan texnika, dil emalından tutmuş səs generasiyasına və robototexnikaya qədər müxtəlif tətbiqləri gücləndirən vəziyyət-məkan modelləri (SSM) kimi tanınan süni intellekt arxitekturaları ailəsini hədəf alır. Tədqiqatçılar, təlim prosesinin əvvəlində lazımsız komponentləri cərrahi yolla çıxarmazdan əvvəl, idarəetmə nəzəriyyəsindən riyazi alətlər götürərək, modelin hansı hissələrinin öz ağırlığını çəkdiyini və hansılarının ölü çəkidə olduğunu müəyyən edə bilərlər.

CSAIL-in filialı və məqalənin aparıcı müəllifi, elektrik mühəndisliyi və kompüter elmləri üzrə doktorantura tələbəsi Makram Şahin deyir: “Bu, mahiyyət etibarilə modellərin təlim keçdikcə daha kiçik və daha sürətli böyüməsini təmin etmək üçün bir texnikadır.” “Öyrənmə zamanı onlar həmçinin inkişafları üçün faydalı olmayan hissələrdən də xilas olurlar.”

Beynəlxalq Təlim Nümayəndəlikləri Konfransında ( ICLR 2026 ) konfrans məqaləsi kimi qəbul edilən iş bu ayın sonunda təqdim olunacaq. Hazırda arXiv preprint serverində mövcuddur .

Əsas anlayışlar və təlim vaxtına qənaət

Əsas fikir budur ki, bu modellər daxilindəki müxtəlif komponentlərin nisbi əhəmiyyəti təlim zamanı təəccüblü dərəcədə erkən sabitləşir. Hər bir daxili vəziyyətin modelin ümumi davranışına nə qədər töhfə verdiyini ölçən Hankel sinqulyar dəyərləri adlanan riyazi kəmiyyətdən istifadə edərək, komanda təlim prosesinin yalnız təxminən 10%-dən sonra hansı ölçülərin vacib, hansılarının isə vacib olmadığını etibarlı şəkildə sıralaya bildiklərini göstərdi. Bu sıralamalar müəyyən edildikdən sonra daha az vacib komponentlər təhlükəsiz şəkildə atıla bilər və təlimin qalan 90%-i daha kiçik bir modelin sürəti ilə davam edir.

MIT professoru və CSAIL direktoru, baş müəllif Daniela Rus deyir: “Bu işdə maraqlı olan odur ki, o, sıxılmanı sonradan düşünülmüş vəziyyətdən öyrənmə prosesinin özünün bir hissəsinə çevirir. CompreSSM, böyük bir modeli öyrətmək və sonra onu necə kiçiltməyi öyrənmək əvəzinə, modelin öyrəndikcə öz səmərəli strukturunu kəşf etməsinə imkan verir. Bu, süni intellekt sistemlərinin qurulması haqqında tamamilə fərqli bir düşüncə tərzidir.”

Əsas meyarlar üzrə performans artımları

Nəticələr təəccüblüdür. Təsvir təsnifatı etalonlarında, sıxılmış modellər tam ölçülü həmkarları ilə demək olar ki, eyni dəqiqliyi qoruyub saxlayıb və 1,5 dəfəyə qədər daha sürətli məşq ediblər. Orijinal hal ölçüsünün təxminən dörddə birinə qədər azaldılmış sıxılmış model CIFAR-10 etalonunda 85,7% dəqiqliyə nail olub, sıfırdan həmin kiçik ölçüdə təlim keçmiş model üçün isə bu rəqəm cəmi 81,8% olub. Ən çox istifadə edilən hal-məkan arxitekturalarından biri olan Mamba-da metod təxminən 4 dəfə təlim sürətinə nail olub və rəqabət qabiliyyətini qoruyaraq 128 ölçülü modeli təxminən 12 ölçüyə qədər sıxışdırıb.

“Siz daha böyük modelin performansını əldə edirsiniz, çünki mürəkkəb dinamikanın əksəriyyətini isinmə mərhələsində ələ keçirir, sonra isə yalnız ən faydalı vəziyyətləri saxlayırsınız”, – deyə Çahin bildirir. “Model hələ də kiçik bir modeli əvvəldən öyrətməkdən daha yüksək səviyyədə çıxış edə bilir.”

CompreSSM digər metodlardan necə fərqlənir

CompreSSM-i mövcud yanaşmalardan fərqləndirən şey onun nəzəri əsaslandırılmasıdır. Ənənəvi budama metodları tam bir modeli öyrədir və sonra parametrləri aradan qaldırır, yəni böyük modeli öyrətməyin tam hesablama xərcini yenə də ödəyirsiniz. Digər məşhur bir texnika olan bilik distilləsi, böyük bir “müəllim” modelini sona qədər öyrətməyi və sonra onun üzərinə ikinci, daha kiçik bir “tələbə” modelini öyrətməyi tələb edir ki, bu da təlim səyini mahiyyət etibarilə ikiqat artırır. CompreSSM, ortada məlumatlı sıxılma qərarları verməklə hər iki xərcdən qaçınır.

Komanda, CompreSSM-i hər iki alternativlə üz-üzə müqayisə etdi. Kompakt vəziyyət-məkan modellərini təşviq etmək üçün bu yaxınlarda təklif edilən spektral texnika olan Hankel nüvə normasının nizamlanması ilə müqayisədə, CompreSSM 40 dəfədən çox daha sürətli idi və eyni zamanda daha yüksək dəqiqliyə nail oldu. Requlyarlaşdırma yanaşması təlimi təxminən 16 dəfə yavaşlatdı, çünki hər bir qradiyent addımında bahalı öz dəyər hesablamaları tələb edirdi və hətta bu halda da nəticədə yaranan modellər zəif nəticə göstərdi.

CIFAR-10 üzərində bilik distilləsinə qarşı, CompressSM ağır sıxılmış modellər üçün açıq bir üstünlük təşkil etdi: Kiçik vəziyyət ölçülərində distillə edilmiş modellər əhəmiyyətli dərəcədə dəqiqlik azalması müşahidə etdi, CompreSSM ilə sıxılmış modellər isə demək olar ki, tam performansı qorudu. Distillə hər təlim mərhələsində həm müəllim, həm də tələbə vasitəsilə irəli keçid tələb etdiyindən, hətta daha kiçik tələbə modelləri belə tam ölçülü baza xəttindən daha yavaş məşq etdi.

Nəzəriyyə, zəmanətlər və praktik təhlükəsizlik şəbəkəsi

Tədqiqatçılar riyazi olaraq sübut etdilər ki, Veyl teoreminin tətbiqi sayəsində fərdi model vəziyyətlərinin əhəmiyyəti təlim zamanı rəvan şəkildə dəyişir və empirik olaraq bu vəziyyətlərin nisbi reytinqlərinin sabit qaldığını göstərdilər. Birlikdə, bu tapıntılar praktikantlara erkən mərhələdə əhəmiyyətsiz kimi müəyyən edilən ölçülərin sonradan birdən-birə kritik hala gəlməyəcəyinə inam verir.

Metod həmçinin praqmatik təhlükəsizlik şəbəkəsi ilə gəlir. Əgər sıxılma addımı gözlənilməz performans azalmasına səbəb olarsa, praktiklər əvvəllər saxlanılan yoxlama nöqtəsinə qayıda bilərlər. “Bu, insanlara daha az intuitiv enerji həddini müəyyən etmək əvəzinə, performans baxımından nə qədər ödəməyə hazır olduqları üzərində nəzarət imkanı verir”, – deyə Çahin izah edir.

Metod harada ən yaxşı işləyir

Texnikanın bəzi praktik sərhədləri var. CompreSSM, daxili vəziyyət ölçüsü ilə ümumi performans arasında güclü bir korrelyasiya nümayiş etdirən modellərdə ən yaxşı şəkildə işləyir, bu xüsusiyyət tapşırıqlar və arxitekturalar arasında dəyişir. Metod, vəziyyət ölçüsü ilə ifadəlilik arasındakı əlaqənin ən güclü olduğu çoxgirişli, çoxçıxışlı (MIMO) modellərdə xüsusilə təsirlidir. Hər kanallı, təkgirişli, təkçıxışlı arxitekturalar üçün qazanclar daha azdır, çünki bu modellər əvvəlcə vəziyyət ölçüsü dəyişikliklərinə daha az həssasdırlar.

Nəzəriyyə, daha çox xətti zamana bağlı olmayan sistemlərə tətbiq olunur, baxmayaraq ki, komanda getdikcə populyarlaşan girişdən asılı, zamana görə dəyişən arxitekturalar üçün genişləndirmələr hazırlayıb. Vəziyyət-məkan modelləri ailəsi ənənəvi transformatorlara alternativ olaraq artan maraq sahəsi olan xətti diqqət kimi arxitekturalara da şamil edildiyindən, potensial tətbiq dairəsi genişdir.

Gələcək istiqamətlər

Şahin və əməkdaşları bu işi bir addım kimi görürlər. Komanda artıq Mamba kimi xətti zamanla dəyişən sistemlərə genişlənmə nümayiş etdirib və gələcək istiqamətlərə CompreSSM-i xətti diqqət mexanizmlərində istifadə olunan matris dəyərli dinamik sistemlərə daha da irəli aparmaq daxildir ki, bu da texnikanı bugünkü ən böyük süni intellekt sistemlərinin əksəriyyətinin əsasını təşkil edən transformator arxitekturalarına daha da yaxınlaşdıracaq.

“Bu, ilk addım olmalı idi, çünki nəzəriyyənin dəqiq olduğu və yanaşmanın prinsipial olaraq qala biləcəyi yer budur”, – deyə Çahin bildirir. “Bu, insanların bu gün sənayedə istifadə etdiyi digər arxitekturalara da şamil etmək üçün bir addımdır.”

“Şahin və həmkarlarının işi müasir vəziyyət-məkan modelləri (SSM) üçün sıxılma mövzusunda maraqlı, nəzəri cəhətdən əsaslandırılmış bir perspektiv təqdim edir”, – deyə tədqiqatda iştirak etməyən ELLIS İnstitutunun Tübingendəki baş tədqiqatçısı və Ağıllı Sistemlər üzrə MPI müstəqil qrup rəhbəri Antonio Orvieto bildirib.

“Metod, təlim zamanı bu modellərin vəziyyət ölçüsünün effektiv şəkildə azaldıla biləcəyinə və nəzarət-nəzəri perspektivin bu proseduru uğurla istiqamətləndirə biləcəyinə dair dəlillər təqdim edir. İş gələcək tədqiqatlar üçün yeni yollar açır və təklif olunan alqoritm böyük SSM əsaslı modellərin əvvəlcədən təlimi zamanı standart bir yanaşma olmaq potensialına malikdir.”