Süni intellekt modelindəki dəyişikliklər “barmaq izləri” yeniləməsi vasitəsilə həssas məlumatları sızdıra bilər

İnqrid Fadelli , Phys.org tərəfindən

redaktə edən: Gaby Clark , rəy verən: Robert Egan

Tercih edilən mənbə kimi əlavə edin

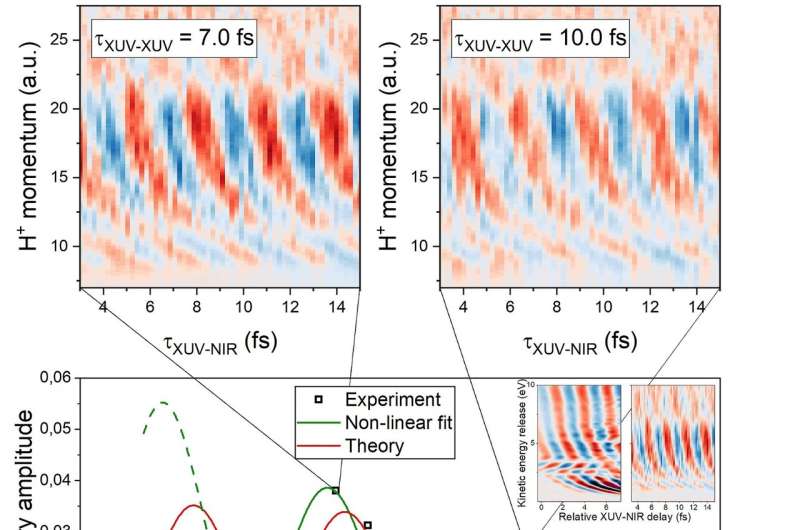

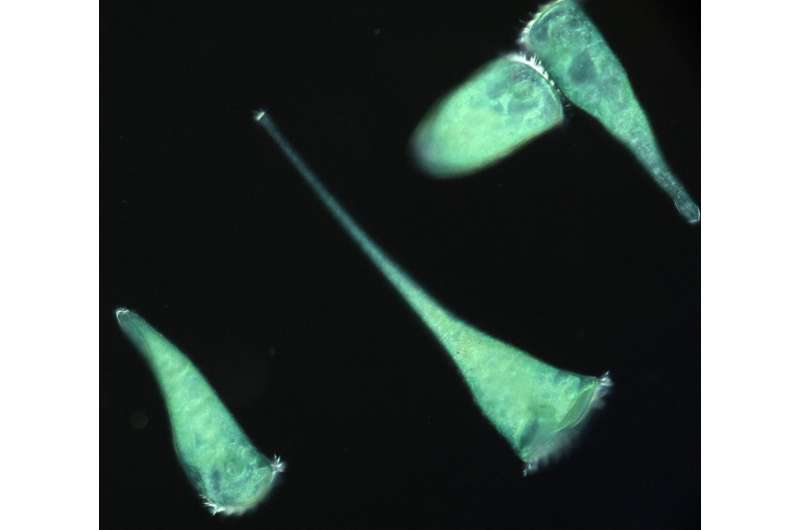

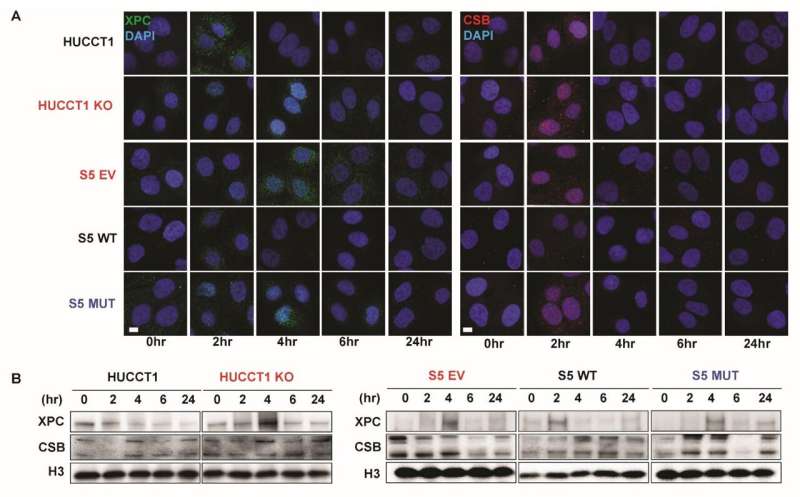

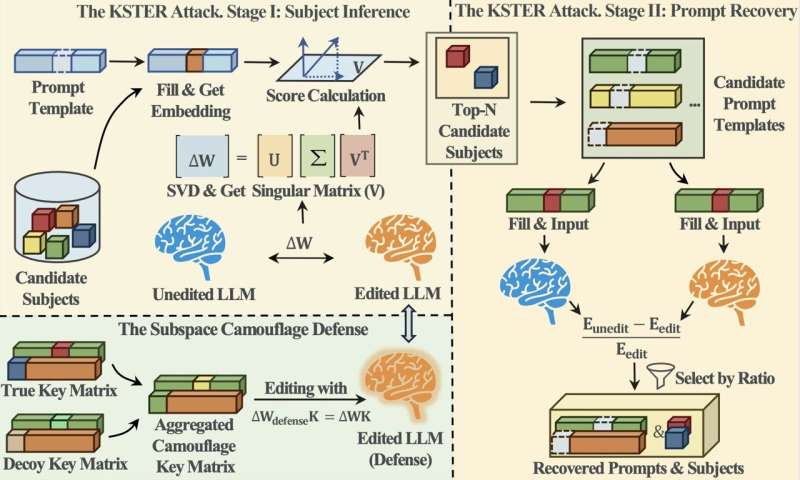

Komandanın təklif etdiyi iki mərhələli tərs mühəndislik hücum çərçivəsi KSTER-in ağ qutu şəraitində icmalı və əlaqəli müdafiə strategiyası alt məkan kamuflyajı. Müəllif: Sun və başqaları.

Süni intellekt (Sİ) sistemləri hazırda dünyada milyonlarla insan tərəfindən məlumat əldə etmək və ya müəyyən tapşırıqları daha sürətli və səmərəli şəkildə həll etmək üçün alətlər kimi geniş istifadə olunur. Bu gün ən çox istifadə edilənlərdən bəziləri müxtəlif dillərdə yazılı məzmunu emal edə və yarada bilən böyük mətn kolleksiyaları üzərində təlim keçmiş hesablama modelləri olan böyük dil modelləridir (LLM).

Artan populyarlığına baxmayaraq, LLM-lərin potensial riskləri hələ də aydın şəkildə izah edilməyib. Bəzi keçmiş tədqiqatlar göstərir ki, bu modellər bəzən faktiki olaraq səhv olan və ya istifadəçinin sorğusu ilə uyğun olmayan məzmun yarada bilər, lakin onların kiberhücumlara qarşı mümkün zəiflikləri hələ də zəif başa düşülür.

Şanxay Qi Zhi İnstitutu, Şərqi Çin Normal Universiteti, Tsinhua Universiteti və Çin Elmlər Akademiyasının tədqiqatçıları bu yaxınlarda LLM kodunu düzəltməyə və ya istifadəçilər tərəfindən verilən məlumatları silməyə yönəlmiş prosedurların kiberhücumçular tərəfindən məxfi məlumatlara daxil olmaq üçün istifadə edilə biləcəyini göstərdilər. Onların arXiv preprint serverində dərc olunmuş məqaləsində həmçinin bu yeni müəyyən edilmiş təhlükəsizlik riskini azaltmağa kömək edə biləcək bir yanaşma təqdim olunur.

Zhiyu Sun, Minrui Luo və həmkarları məqalələrində yazırdılar ki, “Böyük dil modelləri (LLM) trilyonlarla token ehtiva edən korpuslar üzərində əvvəlcədən təlim keçir və buna görə də qaçılmaz olaraq həssas məlumatları yadda saxlayır”. “Model redaktəsinin əsas paradiqması kimi yerini müəyyən etmə və sonra redaktə etmə metodları, yenidən təlim keçmədən model parametrlərini dəyişdirməklə perspektivli bir həll təklif edir.”

“Lakin, bu işdə biz bu paradiqmanın kritik bir zəifliyini ortaya qoyuruq: parametr yeniləmələri təsadüfən yan kanal kimi xidmət edir və hücum edənlərə redaktə edilmiş məlumatları bərpa etməyə imkan verir. Biz bu yeniləmələrin aşağı dərəcəli strukturundan istifadə edən textit{KSTER} (textbf{K}eytextbf{S}paceReconstextbf{T}ruction-then-textbf{E}ntropytextbf{R}eduction) adlı iki mərhələli tərs mühəndislik hücumu təklif edirik.”

LLM-lərə qarşı yeni aşkar edilmiş hücum

LLM-lərin buraxdığı səhvləri düzəltmək və ya saxlanılan məlumatları silmək üçün kompüter alimləri tez-tez modelin redaktə strategiyalarından istifadə edirlər ki, bu da onlara modelin daxili parametrlərini tənzimləməyə imkan verir. “Tap-sonra redaktə et” kimi tanınan geniş istifadə olunan model redaktə üsulu, LLM-in istənməyən məlumatların yaradılmasından ən çox məsul olan hissələrini müəyyən etmək və sonra bu hissələrlə əlaqəli parametrləri birbaşa dəyişdirmək üçün hazırlanmışdır.

Sun, Luo və həmkarları göstərdilər ki, bu parametr dəyişiklikləri həssas istifadəçi məlumatlarını sızdıra bilər və dolayı yolla heç bir məlumatı açıqlamaq üçün nəzərdə tutulmayan siqnallar vasitəsilə onu ifşa edə bilər. Tədqiqatçılar bu təhlükəsizlik zəifliyindən istifadə edən bir hücum hazırladılar və GPT-J, Llama-3 və Qwen-2.5 daxil olmaqla müxtəlif LLM-lərdən həssas məlumatları uğurla çıxardığını göstərdilər.

Sun, Luo və həmkarları yazırdılar: “Birincisi, nəzəri olaraq göstəririk ki, yeniləmə matrisinin sətir boşluğu redaktə edilmiş subyektlərin “barmaq izini” kodlayır və spektral analiz vasitəsilə subyektin dəqiq bərpasına imkan verir. İkincisi, redaktənin semantik kontekstini yenidən quran entropiya əsaslı təcili bərpa hücumu təqdim edirik. Birdən çox LLM üzərində aparılan geniş təcrübələr göstərir ki, hücumlarımız redaktə edilmiş məlumatları yüksək uğur nisbətləri ilə bərpa edə bilər.”

Yeni aşkar edilmiş hücumun yumşaldılması

Bu tədqiqat qrupu tərəfindən toplanan nəticələr göstərir ki, LLM-i redaktə etmək adətən problemləri yenidən hazırlıqdan daha tez həll etsə də, eyni zamanda əhəmiyyətli təhlükəsizlik riskləri yaradır. Sun, Luo və həmkarları öz məqalələrində model redaktə prosesləri zamanı həssas məlumatların dolayı yolla çıxarılma riskini azalda biləcək yeni bir müdafiə strategiyası təqdim etdilər.

Müəlliflər yazırdılar ki, “Biz textit{alt fəza kamuflyajı} təklif edirik. Bu, yeniləmə barmaq izini semantik tələlərlə qarışdıran müdafiə strategiyasıdır. Bu yanaşma redaktə faydasından ödün vermədən yenidənqurma risklərini effektiv şəkildə azaldır.”

Tədqiqatçılar tərəfindən hazırlanmış hücum kodu və onların hazırladığı müdafiə strategiyası GitHub-da mövcuddur . Digər tədqiqat qrupları tezliklə öz məqalələrini inkişaf etdirə və silinmiş həssas məlumatların zərərli şəkildə bərpası üçün tərs mühəndisliyə əsaslanan model redaktə strategiyasının təsirini daha da qiymətləndirə bilərlər.

Gələcəkdə bu son tədqiqat, LLM-lər tərəfindən saxlanılan həssas məlumatların qorunmasına yönəlmiş digər müdafiə və təhlükəsizlik vasitələrinin hazırlanmasına da təsir göstərə bilər. Ümumilikdə, bu səylər bu modellərin təhlükəsizliyini artırmağa, istifadəçiləri qorumağa və həssas məlumatların sızmasını məhdudlaşdırmağa kömək edə bilər.

Müəllifimiz İnqrid Fadelli tərəfindən sizin üçün yazılmış, Qeb Klark tərəfindən redaktə edilmiş və Robert İqan tərəfindən faktlar yoxlanılmış və nəzərdən keçirilmiş bu məqalə diqqətli insan əməyinin nəticəsidir. Müstəqil elmi jurnalistikanı yaşatmaq üçün sizin kimi oxuculara güvənirik. Əgər bu reportaj sizin üçün vacibdirsə, xahiş edirik ianə etməyi (xüsusilə aylıq) nəzərdən keçirin. Təşəkkür olaraq reklamsız hesab əldə edəcəksiniz .

Nəşr detalları

Zhiyu Sun və digərləri, Dil Modellərində Tərs Mühəndislik Modelinin Redaktəsi, arXiv (2026). DOI: 10.48550/arxiv.2602.10134

Jurnal məlumatı: arXiv

Əsas anlayışlar

Böyük dil modelləriEtibarlı maşın öyrənməsi

© 2026 Science X Network