Süni intellekt qərarların qəbul edilməsinə kömək etdikdə, insanlar nə vaxt üstün tutmalıdırlar?

184 milyard dollarlıq süni intellekt bazarında heç bir yavaşlama əlaməti yoxdur. Bu bazarın böyük bir hissəsi qərar qəbul etmək üçün süni intellektdən istifadə edən müəssisələrdən tutmuş dövlət qurumlarına qədər təşkilatlardır. IBM tərəfindən 2023-cü ildə aparılan bir araşdırma, CEO-ların 43%-nin strateji qərarlar qəbul etmək üçün süni intellektdən istifadə etdiyini müəyyən etdi.

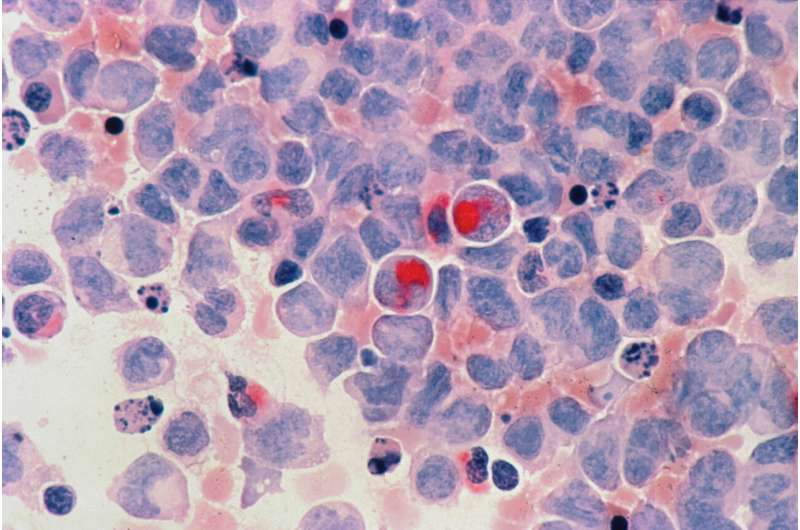

Lakin irq və cinsə görə stereotiplər də daxil olmaqla, qərəzliliyin yaxşı sənədləşdirilmiş tarixini nəzərə alsaq, süni intellektə etibar etmək problemli ola bilər . Süni intellekt demoqrafik göstəriciləri müəyyən insanlara bank krediti və ya iş müsahibəsi verməkdən çəkindirdiyi zaman bu, qüsurlu tövsiyələrə və ədalətsiz rəftara səbəb ola bilər .

Mütəxəssislərin fikrincə, bu problemləri azaltmağın bir yolu süni intellekt sistemlərini izah etməkdir. Məsələn, AI-nin necə qərar qəbul etmələri ilə bağlı “izahını” nəzərdən keçirərək, insan işə götürmə menecerləri və ya kredit mütəxəssisləri, məsələn, AI tövsiyələrini ləğv edib-etməmək barədə qərar verə bilərlər.

Lakin Texas McCombs-dan yeni araşdırmalar izahatların özləri problemli ola biləcəyini tapır. Onlar dəqiqliyə və ya ədalətə əsaslanmadan ədalət anlayışını gücləndirə bilərlər.

Məlumat, risk və əməliyyatların idarə edilməsi üzrə dosent Maria De-Arteaga deyir: “Bizim tapdığımız odur ki, bu proses insanları əslində daha keyfiyyətli qərarlar və ya daha ədalətli qərarlar qəbul etməyə sövq etmir”.

Tədqiqatda De-Arteaga və onun həmmüəllifləri – Almaniyanın Bayreuth Universitetinin doktoranturadan sonrakı tədqiqatçıları Jakob Schoeffer və Niklas Kühl süni intellekt sistemi ilə 134.436 onlayn tərcümeyi-hal oxudu və hər bir insanın müəllim və ya professor olduğunu proqnozlaşdırdı.

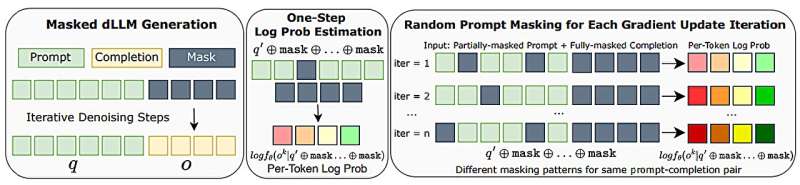

Daha sonra insan iştirakçılarına bios oxumağa və süni intellekt tövsiyələrini ləğv edib-etməməyi seçməyə icazə verildi. İki növ izahat var idi və hər bir iştirakçı ikidən birini gördü:

- “Araşdırma” və ya “məktəblər” kimi tapşırıqla əlaqəli açar sözləri vurğulayan izahatlar.

- “O” və ya “o” kimi genderlə əlaqəli açar sözləri vurğulayan izahatlar.

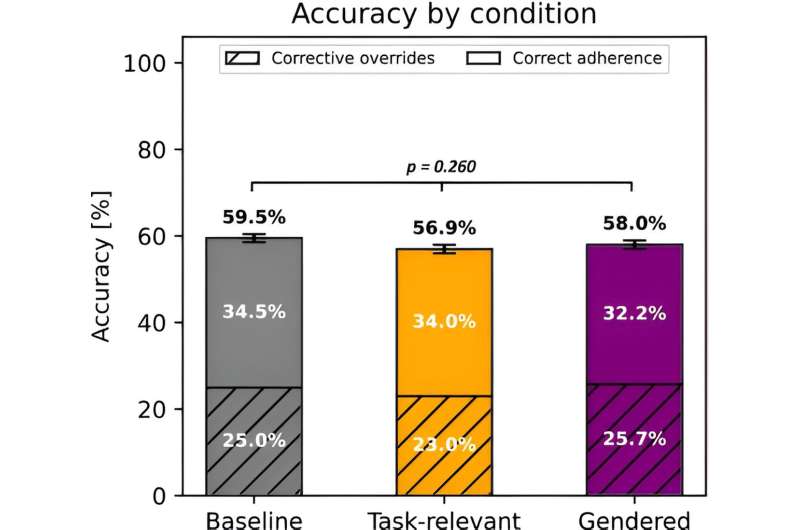

Tədqiqat müəyyən etdi ki, izahatlar tapşırıqla əlaqəli deyil, cinsiyyəti vurğuladıqda, iştirakçıların süni intellektlə bağlı tövsiyələrə üstünlük vermə ehtimalı 4,5 faiz bəndi çoxdur.

Əsas səbəb: şübhəli gender qərəzliyi. İştirakçılar cinsə diqqət yetirdikdə tövsiyələrin ədalətsiz olduğunu düşünməyə daha çox inanırdılar.

https://googleads.g.doubleclick.net/pagead/ads?gdpr=0&us_privacy=1—&gpp_sid=-1&client=ca-pub-0536483524803400&output=html&h=135&slotname=2793866484&adk=675901022&adf=1873531024&pi=t.ma~as.2793866484&w=540&abgtt=6&fwrn=4&lmt=1723147484&rafmt=11&format=540×135&url=https%3A%2F%2Ftechxplore.com%2Fnews%2F2024-08-ai-aids-decisions-humans-override.html&wgl=1&uach=WyJXaW5kb3dzIiwiMTAuMC4wIiwieDg2IiwiIiwiMTI3LjAuNjUzMy45OSIsbnVsbCwwLG51bGwsIjY0IixbWyJOb3QpQTtCcmFuZCIsIjk5LjAuMC4wIl0sWyJHb29nbGUgQ2hyb21lIiwiMTI3LjAuNjUzMy45OSJdLFsiQ2hyb21pdW0iLCIxMjcuMC42NTMzLjk5Il1dLDBd&dt=1723147444260&bpp=3&bdt=1336&idt=1080&shv=r20240801&mjsv=m202408050101&ptt=9&saldr=aa&abxe=1&cookie=ID%3D3b199fcd67477665%3AT%3D1722782760%3ART%3D1723147444%3AS%3DALNI_MYiVAjEyy4dUxgOksNR26c7Dw2QPA&eo_id_str=ID%3Dd042eab5cd0e9128%3AT%3D1722782760%3ART%3D1723147444%3AS%3DAA-AfjaezaeceO7ROnaS-eCO7629&prev_fmts=0x0&nras=1&correlator=4931700396590&frm=20&pv=1&rplot=4&u_tz=240&u_his=1&u_h=900&u_w=1440&u_ah=860&u_aw=1440&u_cd=24&u_sd=1&dmc=8&adx=347&ady=2121&biw=1423&bih=739&scr_x=0&scr_y=0&eid=44759875%2C44759926%2C44759837%2C95336638%2C44795922%2C95334524%2C95334829%2C95337870%2C31085926%2C31084186%2C95339233%2C95336267%2C31078663%2C31078665%2C31078668%2C31078670&oid=2&pvsid=2998045615473514&tmod=1025037613&uas=0&nvt=1&ref=https%3A%2F%2Fphys.org%2F&fc=1920&brdim=0%2C0%2C0%2C0%2C1440%2C0%2C0%2C0%2C1440%2C739&vis=1&rsz=%7C%7CpeEbr%7C&abl=CS&pfx=0&fu=128&bc=31&bz=0&td=1&tdf=0&psd=W251bGwsbnVsbCwibGFiZWxfb25seV80IiwxXQ..&nt=1&ifi=2&uci=a!2&btvi=1&fsb=1&dtd=40227

Dəqiqlik və ədalət illüziyası

Lakin iştirakçılar həmişə haqlı deyildilər. Professor və ya müəllimlərin müəyyən edilməsinə gəldikdə, gender əsaslı ləğvetmələr tapşırıq əsaslı ləğvetmələrdən daha dəqiq deyildi. Əslində, izahat verilməyən iştirakçılarla müqayisədə heç bir izahat növü insan dəqiqliyini artırmadı.

Nə üçün izahatlar daha yaxşı qərarlara səbəb olmadı? De-Arteaga, tapşırıqla əlaqəli sözləri görən və gender qərəzindən azad olduqlarını düşünən iştirakçılara diqqət yetirir.

Lakin tədqiqat bunun əksini tapdı: bir alqoritm vəzifəyə uyğun görünən sözlər və cins arasında korrelyasiya öyrənməklə gender qərəzliyi inkişaf etdirə bilər. İzahatlar belə qərəzliliyi ortaya qoymur. İnsanlar yanlış olaraq süni intellektin cins baxımından neytral olduğunu düşünürlər və onu ləğv etməkdən imtina edirlər.

De-Arteaga deyir: “İzahların insanlara tövsiyənin səhv və ya qərəzli olub olmadığını ayırd etməsinə kömək edəcəyinə ümid var”. “Ancaq izahatların etdikləri ilə onların etməsini istədiklərimiz arasında bir əlaqə var.”

Müəyyən amillərin əhəmiyyətini təxmin etməyə çalışan süni intellektlə bağlı izahatlar mahiyyət etibarilə qüsurlu ola bilsə də, De-Arteaga və onun həmmüəllifləri onların dizaynını və tətbiqini qərar qəbul edənlər üçün daha faydalı etmək üçün bir neçə yol təklif edirlər.

- Qəbul ediləcək qərarlara əsaslanaraq izahatlar üçün daha konkret və real məqsədlər qoyun və onların arzu olunan məqsədə nail olub-olmadığını qiymətləndirin.

- AI sistemində ədalətlə bağlı olanlar kimi izahatlarda daha uyğun işarələr təqdim edin.

- Alqoritmin necə işlədiyinə dair daha çox məlumat verməklə izahların əhatə dairəsini genişləndirin. Məsələn, hansı məlumatların sistemdə mövcud olub olmadığını bilmək insanlara alqoritmlərdən yaxşı istifadə etmək imkanı verə bilər.

- İnsanlar süni intellekt qərarını ləğv etmək qərarına gəldikdə və ya qərar vermədikdə oynayan psixoloji mexanizmləri öyrənin. Tövsiyələr, tədqiqatçıların necə qarşılıqlı əlaqədə olmasını istədiklərini deyil, insanların süni intellektlə necə qarşılıqlı əlaqədə olduğunu əks etdirmək üçün tərtib edilməlidir.

Onun sözlərinə görə, məqsəd insanlara süni intellekt sistemlərini uğurla tamamlamağa kömək edən alətlər hazırlamaqdır – sadəcə olaraq yalançı inam hissi yaradan izahatlar təklif etmək deyil.

“Bu, izahatlarla bağlı problemlərdən biridir” deyir. “Sistem etibarınıza layiq olmasa belə, onlar sizi sistemə daha çox etibar etməyə vadar edə bilərlər.”

” İnsan-AI qərarlarının qəbulunda izahatlar, ədalətlilik və uyğun güvən ” CHI Konfransının Hesablama Sistemlərində İnsan Faktorları üzrə Proceedings kitabında dərc olunub .

Ətraflı məlumat: Jakob Schoeffer et al, Explanations, Fairness, and Appropriate Reliance in Human-AI Decision-qəbuletmə, CHI Conference of Human Factors in Computing Systems (2024). DOI: 10.1145/3613904.3642621Ostindəki Texas Universiteti tərəfindən təmin edilmişdir