Yeni memristor təlim metodu süni intellekt enerji istehlakını altı dəfə azaldır

Tejasri Gururaj tərəfindən , Phys.org

Sadie Harley tərəfindən redaktə edilib , Robert Egan tərəfindən nəzərdən keçirilib

Tercih edilən mənbə kimi əlavə edin

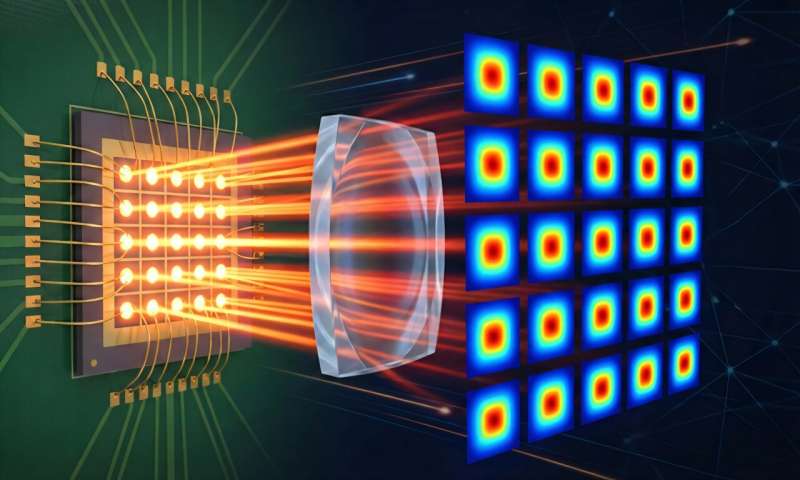

SRNet ×2-nin memristor aparatında tətbiqi. Mənbə: Nature Communications (2025). DOI: 10.1038/s41467-025-66240-7

Nature Communications şirkətinin apardığı bir araşdırmada , Çinli tədqiqatçılar memristor aparatının səs-küylü yeniləmələrini neyron şəbəkəsi təlimi ilə uyğunlaşdıran, enerji istifadəsini GPU-larla müqayisədə təxminən altı dəfə azaltmaqla yanaşı, görmə tapşırıqlarında dəqiqliyi artıran bir səhvdən xəbərdar ehtimal yeniləməsi (EaPU) metodu hazırlayıblar. Tədqiqat EaPU-nu 180 nm memristor massivlərində və genişmiqyaslı simulyasiyalarda təsdiqləyir.

Öz-özünə konfiqurasiya edən optik cihazlar işığı necə ayırmağı avtomatik olaraq öyrənirPlay Video

Memristorlarla analoq yaddaşdaxili hesablama, fiziki qanunlar vasitəsilə matris əməliyyatları yerinə yetirməklə rəqəmsal çiplərin enerji darboğazlarını aradan qaldırmağı vəd edir. Memristorlar, beyin sinapsları kimi yaddaş və emalı birləşdirən cihazlardır.

IBM və Stanford çipləri tərəfindən göstərildiyi kimi, bu sistemlər üzərində nəticə çıxarmaq yaxşı işləyir. Lakin dərin neyron şəbəkələrinin öyrədilməsi bir problemlə üzləşir: memristor çəkilərini təyin edərkən “yazma” xətaları.

Bunu nasaz radio düyməsindəki düyməni dəqiq tənzimləməyə çalışmaq kimi düşünün – nəzərdə tutulan kiçik təkan proqramlaşdırma tolerantlıqlarından və yazı sonrası sürüşmədən yaranan səs-küydə itib gedir və çəkilər geri yayılmanın tələb etdiyi kimi dəqiq şəkildə yerləşmək əvəzinə vəhşicəsinə sıçrayır. Bu stoxastik qarışıqlıq öyrənməni qeyri-sabitləşdirir, lakin EaPU əksər kiçik tənzimləmələri ağıllı şəkildə atlayaraq və aparatın qəribəliklərinə uyğunlaşdırmaq üçün digərlərini miqyaslandırmaqla yazıları 99%-dən çox azaltmaqla bunu düzəldir.

Phys.org, Zhejiang Lab-dan Jinchang Liu və Tuo Shi, eləcə də Fudan Universitetindən Qi Liu ilə söhbət etdi. Onlar EaPU-nun bu boşluğu necə aradan qaldırdığını ətraflı izah etdilər.

“Çoxsaylı tədqiqatlar memristor əsaslı yaddaşdaxili hesablamaların əhəmiyyətli enerji səmərəliliyi nümayiş etdirdiyini təsdiqləyib”, – deyə komanda bildirib.

Bununla belə, onlar qeyd etdilər ki, təlim hələ də sabitlik və hiperparametr həssaslığı kimi maneələrlə üzləşir və zamanla artan yazma səhvləri ilə qarşılaşır. EaPU əsas alqoritm – aparat uyğunsuzluğu ilə birbaşa mübarizə aparır.

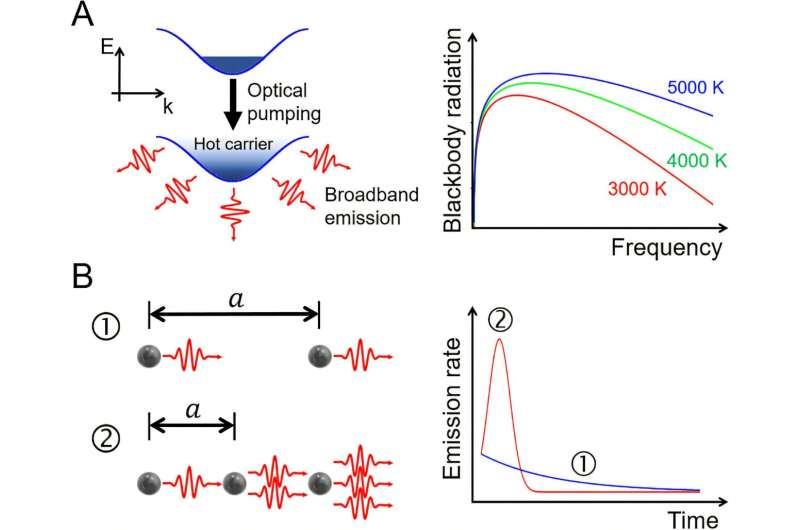

Analoq təliminin çətinliyi. a: Memristor əsaslı hesablamaların məhdudiyyətləri. b: Analoq və alqoritm əsaslı təlim prosesləri arasındakı fərq. Kredit: J. Liu və digərləri/ Nature Communications . DOI: 10.1038/s41467-025-66240-7.

Alqoritm — aparat uyğunsuzluğu

Geriyə yayılma alqoritmləri standart neyron şəbəkələrində təlim zamanı şəbəkə çəkilərində kiçik və dəqiq düzəlişlər edir. Bu, itki funksiyasından qradiyentləri hesablamaqla və səhvləri təbəqə-təbəqə geriyə yaymaqla, proqnozlaşdırma səhvlərini minimuma endirmək üçün sinaptik gücləri davamlı olaraq təkanlayaraq işləyir.

Lakin, Memristorlar gözlənilməz cihazlardır. Keçiricilik dəyərləri proqramlaşdırma səhvləri və cihazın relaksasiyası səbəbindən təsadüfi olaraq dəyişir ki, bu da saxlanılan dəyərlərin zamanla sürüşməsinə səbəb olur.

Komanda izah etdi ki, “Çoxsaylı təcrübələrdə memristorların yeniləmə (yazma) xətasının zamanla artdığını müşahidə etdik ki, bu da əsasən cihazın relaksasiya xüsusiyyətlərindən təsirlənir”.

“Bu problem təlimin sabitliyinə və performansına mənfi təsir göstərir; buna görə də cihaz yeniləmə xətası ilə alqoritmin çəki yeniləmə miqyası arasındakı uyğunsuzluğu aradan qaldırmaq üçün bu tədqiqatı apardıq.”

Tədqiqatçılar neyron şəbəkələrində istənilən çəki yeniləmələrinin adətən memristor cihazlarına xas olan səs-küydən 10-100 dəfə kiçik olduğunu aşkar etdilər. Əvvəlki yanaşmalar ya sürət üçün dəqiqliyi qurban verirdi, ya da cihazları dəqiq vəziyyətə gətirməyə çalışarkən həddindən artıq enerji sərf edirdi – heç bir həll yolu genişmiqyaslı yerləşdirmə üçün qənaətbəxş olmadı.

Qeyri-müəyyənliyi qəbul etmək

Cihaz səs-küyünə qarşı mübarizə aparmaq əvəzinə, EaPU onunla işləyir. Metod, kiçik, deterministik çəki yeniləmələrini hesablanmış ehtimalla tətbiq olunan daha böyük, diskret yeniləmələrə çevirən ehtimal yanaşmasından istifadə edir.

Komanda izah etdi ki, “Standart geri yayılma alqoritminin yeniləmə böyüklükləri adətən deterministik və kiçik dəyərlidir, memristiv cihazların stoxastik xüsusiyyətləri isə onlar tərəfindən yenilənən keçiriciliyi böyük və stoxastik edir”.

EaPU, təlim performansını qoruyarkən bu kiçik deterministik yeniləmələri böyük stoxastik yeniləmələrə çevirir.

Mexanizm sadə olaraq qalır: çəki yeniləməsi səs-küy həddindən aşağı düşdükdə , EaPU istənilən dəyişikliyə mütənasib ehtimalla tam bir eşik impulsu tətbiq edir və ya tamamilə atlayır. Daha böyük yeniləmələr dəyişməz olaraq keçir.

Komanda bildirib ki , “EaPU metodunun əsas konsepsiyası, standart geri yayılma alqoritminin yeniləmə böyüklüyü ΔW-nin ehtimal transformasiya yolu ilə memristor yeniləmə böyüklüyü ΔW th- ə dəyişdirilməsi və təlim performansını təmin etmək üçün yeniləmələrin orta dəyərinin dəyişməz qalmasıdır”.

Bu yanaşmanın dramatik yan təsiri var. Təlim zamanı yenilənməli olan parametrlərin sayını 0,1%-dən az azaldır. 152 qatlı ResNet neyron şəbəkəsi üçün hər hansı bir mərhələdə hər min parametrdən yalnız 0,86-sı yeniləmə tələb edirdi ki, bu da 99%-dən çox azalma deməkdir.

Ölçülər üzrə təsdiqləmə

Komanda öz yanaşmalarını həm eksperimental, həm də simulyasiya yolu ilə təsdiqlədi. Xüsusi hazırlanmış 180 nanometrlik memristor massivindən istifadə edərək , neyron şəbəkələrini görüntü səs-küyünün azaldılması və super qətnamə tapşırıqları üçün öyrətdi və müvafiq olaraq 0,896 və 0,933 struktur oxşarlıq indekslərinə nail oldu – nəticələr enerjinin kiçik bir hissəsindən istifadə edərkən ənənəvi təlim metodlarına uyğun və ya onu aşdı.

Komanda qeyd edib ki, “Eksperimental nəticələr EaPU-nun memristor əsaslı təlim strategiyalarında effektivliyini qəti şəkildə təsdiqləyir. Bu arada, aparat təcrübələri EaPU-nun aşağı yeniləmə tezliyini və digər memristorla əlaqəli səs-küyə qarşı möhkəmliyini nümayiş etdirə bilər.”

Daha böyük şəbəkələr üçün, mövcud aparat təminatlarında sınaqdan keçirmək praktik olmayan tədqiqatçılar eksperimental məlumatlara əsaslanan simulyasiya vasitələrindən istifadə etdilər. Onlar 152 təbəqəyə qədər ResNet arxitekturalarını və müasir Vision Transformer modellərini uğurla öyrətdilər və səs-küylü aparat təminatlarında standart geri yayma metodları ilə müqayisədə 60%-dən çox dəqiqlik artımı nümayiş etdirdilər.

Enerji üstünlükləri göz qabağındadır. Əvvəlki memristor təlim yanaşmaları ilə müqayisədə EaPU təlim enerjisini 50 dəfə, ən müasir MADEM metodu ilə müqayisədə isə 13 dəfə azaldır. Yeniləmə tezliyinin kəskin şəkildə azalması cihazın ömrünü təxminən 1000 dəfə uzadır ki, bu da kommersiya baxımından vacib bir amildir.

Gələcək işlər

Tədqiqatçılar metodlarının memristorlardan kənarda daha geniş tətbiqlərini görürlər.

” EaPU metodu geniş tətbiq perspektivlərinə malikdir və aşağıdakı istiqamətlərdə genişləndirilə bilər”, – deyə komanda ferroelektrik tranzistorlar və maqnitorezistiv RAM kimi digər yaddaş texnologiyalarına potensial genişləndirmələri qeyd edərək bildirib.

Bəlkə də ən əhəmiyyətlisi, komanda EaPU-nu böyük dil modelləri üçün təlim klasterlərinə tətbiq etməyi nəzərdə tutur.

Komanda qeyd edib ki, süni intellekt modelləri getdikcə böyüdükcə və enerji xərcləri artdıqca bu, vacib bir məsələdir. “EaPU-nun aşağı yeniləmə tezliyi xüsusiyyətindən istifadə etməklə, bu, aparat sistemlərinin xidmət müddətini artıra və təlim enerjisi istehlakını azalda bilər”.

Təkcə böyük model təlimləri milyonlarla enerji sərf etdiyindən, altı bal gücündə artım süni intellekt iqtisadiyyatını və dayanıqlığı dəyişdirə bilər.

Müəllifimiz Tejasri Gururaj tərəfindən sizin üçün yazılıb, Sadie Harley tərəfindən redaktə edilib və Robert Egan tərəfindən faktlar yoxlanılıb və nəzərdən keçirilib — bu məqalə diqqətli insan əməyinin nəticəsidir. Müstəqil elmi jurnalistikanı yaşatmaq üçün sizin kimi oxuculara güvənirik. Bu reportaj sizin üçün vacibdirsə, xahiş edirik ianə etməyi düşünün (xüsusilə aylıq). Təşəkkür olaraq reklamsız hesab əldə edəcəksiniz .

Daha çox məlumat: Jinchang Liu və digərləri, Memristiv neyron şəbəkələri üçün xətaya əsaslanan ehtimal təlimi, Nature Communications (2025). DOI: 10.1038/s41467-025-66240-7 .

Jurnal məlumatları: Nature Communications

© 2026 Science X Network